vendredi, 27 mars 2026

La rhétorique de Jensen Huang et l’attente de l’intelligence artificielle forte

La rhétorique de Jensen Huang et l’attente de l’intelligence artificielle forte

Markku Siira

Source: https://markkusiira.substack.com/p/jensen-huangin-retorii...

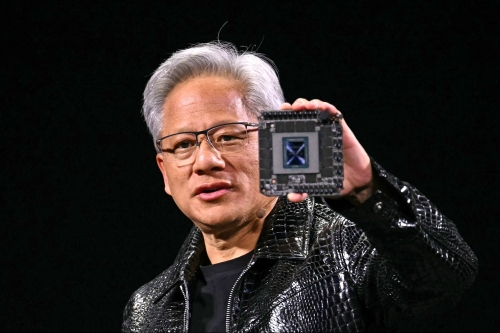

Lorsque Jensen Huang, PDG de l’entreprise technologique Nvidia, a affirmé dans le podcast de Lex Fridman que «l’intelligence artificielle générale (Artificial General Intelligence, AGI) était désormais un objet atteint», cette déclaration n’était pas seulement une évaluation technologique, mais un geste stratégique reflétant les tensions internes au sein de l’industrie de l’IA.

Le commentaire de Huang est un exemple de la façon dont le terme «intelligence artificielle générale» est à la fois et conceptuellement vague et chargé dans la rhétorique des dirigeants technologiques. Il a affirmé «qu’elle était déjà là», mais a aussitôt précisé que même cent mille agents d’IA ne seraient pas capables de construire une entreprise comme Nvidia. Ces déclarations contradictoires révèlent à quel point l’intelligence artificielle peut être définie de manières différentes.

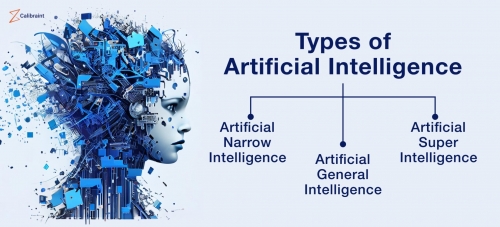

Le vide conceptuel de l’intelligence artificielle générale n’est pas un défaut, mais une caractéristique dont les acteurs du secteur tirent parti. Dans le discours scientifique, l’IA forte désigne un système hypothétique capable de transférer les compétences acquises à un large éventail de tâches diverses, dépassant souvent les performances humaines.

Dans sa conversation avec Huang, Fridman réduit la définition à un aspect opérationnel: pour lui, l’intelligence artificielle générale est un système capable de fonder et de développer une entreprise technologique valant plusieurs milliards de dollars. Ce n’est pas un simple glissement linguistique, mais une redéfinition qui déplace l’accent de la simulation scientifique des capacités cognitives vers un critère purement économique de productivité.

Cette délimitation étroite rend l’intelligence artificielle générale mesurable, même si elle devient un objectif simplifié, ce qui facilite la création de récits d’investissement. Paradoxalement, cela abaisse le seuil pour déclarer l’IA forte comme un objectif atteint: si le critère est simplement d’effectuer une tâche de manière rentable, comme le suggère Fridman, alors une automatisation spécialisée pourrait déjà être considérée comme remplissant cette condition.

Huang saisit cette opportunité. Il fait référence à des agents opérant de façon autonome sur la plateforme OpenClaw ainsi qu’à des influenceurs numériques. Il met ainsi sur le même plan des applications largement répandues mais superficielles et la percée cognitive traditionnellement associée à l’IA forte.

La rectification de Huang n’était pas un signe d’incertitude, mais une partie essentielle d’une communication stratégique. Lorsqu’il affirme qu’un grand nombre d’agents numériques «n’aurait aucune chance» de créer Nvidia, il trace une frontière claire entre deux niveaux: d’un côté l’automatisation des tâches quotidiennes, de l’autre la gestion de la complexité institutionnelle et technologique au plus haut niveau.

La capacité de produire du texte, du code ou d’agir en tant qu’influenceur numérique est différente de la prise de décisions stratégiques, de la résilience et de la gestion de l’innovation à long terme, que Huang voit comme la base du succès de Nvidia. Alors même qu’il déclare l’IA forte comme un objectif atteint, son propre exemple d’intelligence véritable est une entreprise dans la construction de laquelle il a joué un rôle central.

Les propos de Huang peuvent également être lus comme faisant partie d’un phénomène plus large, où les dirigeants technologiques cherchent à se distancier de l’engouement autour de l’IA et des critiques à son égard.

Dans le même temps, le secteur a commencé à développer des termes de remplacement «moins controversés» — par exemple, différentes classifications par niveaux et définitions économiques — tandis que des négociations portant sur des sommes colossales (comme dans les accords entre OpenAI et Microsoft) sont explicitement liées à la définition du but atteint par l’IA forte.

Cette bataille linguistique n’est pas un simple débat académique, mais un exercice de pouvoir. Celui qui décide de ce qui compte comme intelligence artificielle générale décide aussi du moment où les obligations contractuelles sont remplies, quand les limites réglementaires s’appliquent et comment nous comprenons la relation entre la technologie et l’agency humaine.

Huang est un exemple d’acteur du secteur technologique ayant des liens profonds et de longue date avec le département de la Défense américain, l’organisation de recherche DARPA et la communauté du renseignement. Sa déclaration «elle est déjà là» n’est pas une observation neutre, mais une tentative de fixer un standard qui profite avant tout à ceux dont le matériel constitue la base de ces systèmes.

Si l’intelligence artificielle forte était réellement in objectif atteint, la discussion sur son successeur immédiat, la superintelligence (Artificial Superintelligence, ASI), s’ouvrirait immédiatement.

Le philosophe Nick Bostrom définit la superintelligence comme une intelligence qui dépasse la capacité cognitive humaine dans pratiquement tous les domaines pertinents — de la créativité scientifique à l’influence sociale.

Le philosophe Nick Bostrom définit la superintelligence comme une intelligence qui dépasse la capacité cognitive humaine dans pratiquement tous les domaines pertinents — de la créativité scientifique à l’influence sociale.

Il ne s’agirait plus d’un outil piloté par l’homme, mais d’un agent autonome dont la supériorité cognitive le rendrait, en principe, opaque aux humains. L’apparition d’un tel système est alors liée à l’hypothèse de la singularité technologique, selon laquelle la capacité de la superintelligence à s’améliorer elle-même déclencherait une spirale de développement accéléré, impossible à anticiper pour l’homme.

La singularité n’est pas un événement, mais un horizon au-delà duquel l’intelligence humaine ne peut plus s’étendre; il s’agirait d’une rupture fondamentale dans l’histoire de la civilisation. Après cela, la question ne serait plus de savoir qui définit l’intelligence, mais si la superintelligence accepterait encore d’être définie.

Dans cette perspective, les commentaires de Huang dans le podcast montrent qu’il existe encore un profond fossé entre les systèmes actuels et une véritable intelligence institutionnelle durable. Mais si la superintelligence était possible, c’est justement ce fossé qu’elle serait la première à franchir.

La déclaration de Huang peut donc être lue à la fois comme un discours marketing hyperbolique et comme une reconnaissance inconsciente que le véritable changement n’a pas encore eu lieu. Ce qu’il décrit est une automatisation de tâches étroites, définies par l’homme — pas le seuil existentiel que représente la singularité.

L’interview de Huang résume la situation où l’intelligence artificielle générale demeure toujours plus une réalité rhétorique que technique. Même si les applications étroites de l’IA ont atteint des capacités impressionnantes dans la vie quotidienne, les appeler «générales» ou «fortes» suppose soit d’étendre le concept, soit de le réduire à une simple performance économique.

En même temps, la superintelligence et la singularité qui se profilent à l’horizon nous rappellent que la véritable révolution ne serait pas la généralisation des agents qui produisent du code, mais le moment où les machines pourraient faire ce que, selon Huang, elles ne savent pas encore faire: bâtir une entreprise comme Nvidia — ou même diriger des États entiers.

Savoir si ce moment est déjà arrivé, ou s’il aura lieu dans cinq ou cinquante ans, n’est pas seulement une prédiction technologique. C’est une lutte pour savoir qui pourra définir ce qu’est l’intelligence, tout simplement.

19:31 Publié dans Actualité | Lien permanent | Commentaires (0) | Tags : intelligence artificielle, superintelligence artificielle, nvidia, jensen huang, actualité |  |

|  del.icio.us |

del.icio.us |  |

|  Digg |

Digg | ![]() Facebook

Facebook

Écrire un commentaire