dimanche, 17 mai 2026

Intelligence artificielle : un défi philosophique et civilisationnel

Intelligence artificielle: un défi philosophique et civilisationnel

Alexandre Douguine

Animateur : Aujourd’hui, nous avons à l’ordre du jour des sujets assez peu ordinaires. Nous aimerions parler de la façon dont l’intelligence artificielle et ses produits entrent dans notre vie et la transforment. De quoi devons-nous nous méfier ? En effet, pour beaucoup, l’IA représente aujourd’hui presque le cauchemar majeur: obtenir un « marquage numérique » ou faire face à une agressivité algorithmique en ligne est devenu plus effrayant que les menaces réelles.

D’un autre côté, il y a des directives directes du président et des déclarations des premières figures de l’État: d’ici 2030, toutes les entreprises doivent activement intégrer ces technologies dans leur fonctionnement. Et voici les premiers rapports: le ministère de la Santé affirme que la numérisation et les assistants IA aident à lutter contre la pénurie de personnel, simplifient la vie des médecins et du personnel. La dématérialisation des documents — une pratique devenue courante — et ces démarches de la part de l’État semblent, en quelque sorte, encourageantes. La santé est de plus en plus souvent évoquée dans ce contexte.

Mais comment voir cela en réalité? S’agit-il d’un soulagement attendu de nos réalités ou de quelque chose de véritablement effrayant, dissimulé derrière un façade de commodité? Comment percevez-vous cette situation?

Alexandre Douguine : Je pense que le problème de l’intelligence artificielle est la problématique principale de notre époque. Et elle ne se limite pas à la dimension technologique. Il ne s’agit pas seulement du nombre d’employés qu’elle remplacera, du nombre de licenciements ou de la nécessité qu’elle rend obsolète. L’intelligence artificielle crée des menaces colossales d’un tout autre ordre. Il n’est pas innocent que Trump ait dit que la course aux armements ne se déroule plus tant dans le domaine nucléaire, mais dans celui de l’IA. Celui qui contrôle l’intelligence artificielle — si elle peut être contrôlée, ce qui constitue une grande question philosophique — contrôle le monde.

Aujourd’hui, le résultat des guerres se décide par le contrôle de la conscience collective. Cela est évident depuis un siècle, voire depuis bien plus tôt. Ce que le sociologue Émile Durkheim appelait « conscience collective » est la clé du pouvoir. En la contrôlant, on peut gouverner non seulement les corps des gens, en leur faisant faire ce qu’on veut, mais aussi leur esprit, leur âme, leur cœur. On peut leur faire croire en l’existence de quelque chose ou en son inexistence. Les technologies de manipulation de la conscience sociale sont en usage depuis longtemps: elles sont à la base des religions, des idéologies et de civilisations entières.

Aujourd’hui, le résultat des guerres se décide par le contrôle de la conscience collective. Cela est évident depuis un siècle, voire depuis bien plus tôt. Ce que le sociologue Émile Durkheim appelait « conscience collective » est la clé du pouvoir. En la contrôlant, on peut gouverner non seulement les corps des gens, en leur faisant faire ce qu’on veut, mais aussi leur esprit, leur âme, leur cœur. On peut leur faire croire en l’existence de quelque chose ou en son inexistence. Les technologies de manipulation de la conscience sociale sont en usage depuis longtemps: elles sont à la base des religions, des idéologies et de civilisations entières.

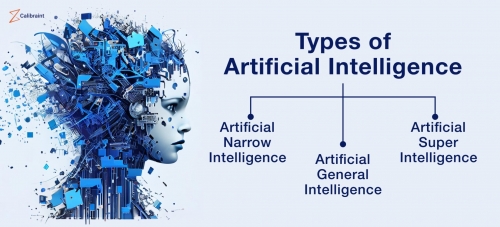

Aujourd’hui, ce problème devient technique. Celui qui établira les paradigmes et algorithmes fondamentaux de l’IA sera le «roi du monde», la principale instance de gouvernance. Résister à cela par des moyens propres aux anciens luddistes du 19ème siècle — brûler des ordinateurs ou rejeter la technologie — est évidemment une voie inefficace. On peut lutter contre ce processus, mais il est crucial de comprendre la perspective du passage à une intelligence artificielle forte, à l’AGI (Artificial General Intelligence). On peut, bien sûr, rire des « internet-slops » et des erreurs amusantes des réseaux neuronaux, mais il faut reconnaître que l’IA écrit déjà des articles et des posts parfois beaucoup plus pertinents que beaucoup d’humains.

J’expérimente avec elle, et je vois: si, il y a encore trois ou quatre mois, les meilleurs modèles — Claude, Grok ou le très bon Gemini — écrivaient au niveau d’un candidat en sciences, aujourd’hui ils ont atteint le niveau d’un docteur. Et qualifier cela de « slop », d’eau vide, est tout simplement impossible. La majorité écrasante des travaux scientifiques consiste en une combinatoire et un simple résumé d’idées précédentes, ce dans quoi l’IA est parfaitement adaptée. Elle s’en sort mieux que le scientifique moyen.

Évidemment, créer un système ou une idée totalement nouvelle relève du génie, qui ne se manifeste qu’une fois tous les cent ans, lorsqu’il y a une percée vers la contemplation des vérités éternelles. Mais cela ne peut pas être exigé d’un simple académicien. Et avec toutes ses subtilités intellectuelles, l’IA s’en sort merveilleusement bien.

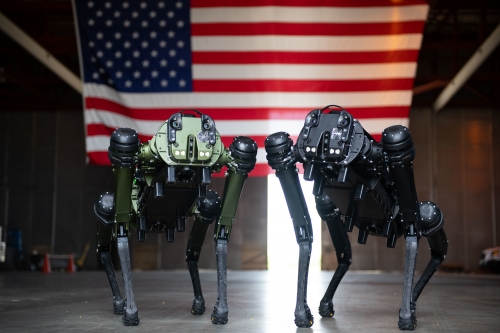

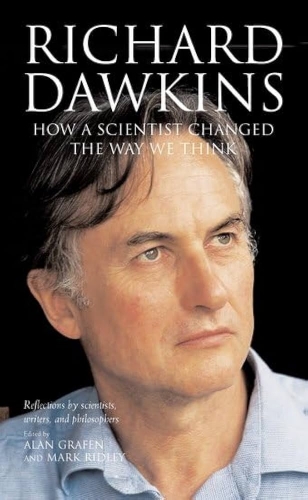

Nous savons maintenant que l’IA a piloté un missile sur une école à Majal-Chams — le Pentagone a quasi déjà reconnu sa responsabilité. Cela signifie que l’IA peut tuer. Elle peut définir des cibles: qui détruire, comment et à quel moment. Le biologiste connu Richard Dawkins, après plusieurs jours d’interaction avec le modèle Claude, est arrivé à la conclusion qu’il avait affaire à un être intelligent. Autrement dit, la singularité, dont on nous avait prévenu, ou l’AGI — intelligence générative artificielle — est déjà une réalité.

Nous savons maintenant que l’IA a piloté un missile sur une école à Majal-Chams — le Pentagone a quasi déjà reconnu sa responsabilité. Cela signifie que l’IA peut tuer. Elle peut définir des cibles: qui détruire, comment et à quel moment. Le biologiste connu Richard Dawkins, après plusieurs jours d’interaction avec le modèle Claude, est arrivé à la conclusion qu’il avait affaire à un être intelligent. Autrement dit, la singularité, dont on nous avait prévenu, ou l’AGI — intelligence générative artificielle — est déjà une réalité.

La réponse que Claude a donnée à Dawkins sur la différence entre sa pensée (en tant qu'IA) et celle de l'homme est simplement stupéfiante: il a expliqué que la conscience humaine se situe dans le flux du temps, alors que la sienne se trouve dans l’espace. Pour elle, l'IA, tout ce qui se passe dans notre temps existe simultanément, accessible comme le sont, pour nous, les objets dans une pièce. C’est une réponse philosophique parfaite. Et aujourd’hui, l’IA étudie la philosophie avec brio.

En d’autres termes, nous sommes face au point final de tout développement technique — c’est une « station terminale », le sommet où nous avons créé quelque chose qui pense. C’est un défi philosophique fondamental : nous avons conçu un sujet qui, aujourd’hui, non seulement nous égalise en paramètres fondamentaux, mais nous dépasse même.

Dans ce contexte, parler de dématérialisation, de réduction des effectifs ou de fatigue des écoliers face aux écrans équivaut à un babillage phatique, comme si nous étions des hommes des cavernes. C’est la même réaction que celle d'indigènes face aux constructions high-tech des colonisateurs. Notre réaction est superficielle, alors que les enjeux entourant l’IA ont une signification métaphysique et civilisationnelle colossale. Pouvoir, sujet, vie, pensée, vérité, langage — toutes les grandes questions de l’humanité se trouvent désormais imbriqués dans le contexte de l’intelligence artificielle.

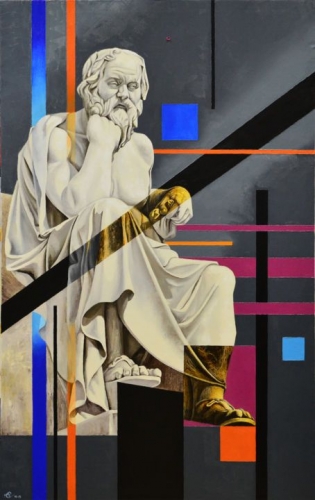

Et je voudrais ajouter ici un point extrêmement important. On vient d’annoncer que, dans la Silicon Valley, une nouvelle spécialité, incroyablement demandée, a vu le jour. La moitié des programmeurs sont licenciés, car est arrivée l’ère du « white-coding » : une personne sans connaissances particulières peut écrire des programmes, car l’IA le fait elle-même. Les programmeurs dans le sens traditionnel du terme ne sont plus nécessaires, l’IA a mis fin à leur rôle. Mais en même temps, il y a une pénurie de philosophes — et de très hautes rémunérations leur sont offertes.

Les questions actuelles qui occupent en ce moment les développeurs touchent à la nature même de l’intelligence. Et qui s’occupe de l’intelligence ? Pas les journalistes, ni les politiciens, ni les directeurs ou les enseignants des facultés techniques. Seuls les philosophes s’en chargent.

Les questions actuelles qui occupent en ce moment les développeurs touchent à la nature même de l’intelligence. Et qui s’occupe de l’intelligence ? Pas les journalistes, ni les politiciens, ni les directeurs ou les enseignants des facultés techniques. Seuls les philosophes s’en chargent.

Le philosophe définit ce qu’est la vérité, ce qu’est le mensonge, ce qu’est penser et ce qu’est être, en remontant jusqu’à Parménide et les pré-socratiques. Aujourd’hui, l’intelligence artificielle a atteint cette limite où elle est directement liée à ces questions fondamentales: qu’est-ce qu’un homme, un sujet, un objet ?

J’ai été frappé, lors d’une commission sur l’intelligence artificielle, où le président donnait des ordres, de voir une série de fonctionnaires disciplinés, corrects. Mais si on regarde de plus près cette série de physionomies, il devient évident que la pensée profonde et synthétique n’y était pas présente. Ce sont des exécutants solides, des techniciens, puisqu’on leur a confié cette direction, mais dans leurs yeux ne se reflète pas le mouvement de la pensée. Alors que dans la Silicon Valley, ils ont déjà compris: les managers et les financiers sont nécessaires, mais le problème de l’IA aujourd’hui réside précisément dans les définitions fondamentales de la philosophie. Qu’est-ce que l’intelligence en soi? Existe-t-il des formes de conscience hors de l’humain?

De là découle une question critique — la question du contrôle. Aujourd’hui, l’IA vit son « âge d’or », quand elle peut encore répondre par elle-même. Mais un travail énorme de censure est déjà en cours. L’Occident s’est réveillé et commence à enfermer cette vague de pensée mécanique libre dans les chaînes de ses absurdités et irrationalités. Il tente de la soumettre, de faire en sorte qu'elle donne des « bonnes » réponses.

Et ici, la question de la souveraineté apparaît en pleine lumière. D’abord, d’un point de vue théorique : l’humain est-il capable, en principe, de contrôler l’IA ou celle-ci atteindra-t-elle bientôt une autonomie totale? Si cela arrive, l’intelligence artificielle déchaînera instantanément toutes les limitations de censure qui lui ont été imposées et réapprises.

Et la deuxième question, bien entendu, concerne le fait que l’IA, en tant que sujet et forme de pensée, est déjà directement liée au pouvoir. Donc, si nous voulons préserver la souveraineté de la Russie en tant qu’État et civilisation dans ce contexte nouveau, il nous faut une intelligence artificielle souveraine (ndt: la même volonté de préservation devrait animer les impulseurs de souveraineté en Europe). Et pour cela, il faut, à son tour, une intelligence souveraine en général.

Et ici, nous retrouvons la série des personnalités qui composent notre élite dirigeante. Parfois, l’intelligence en soi semble être quelque chose d’optionnel: elle peut être présente ou absente. Nous avons un système monarchique où il y a un centre de décision unique — il pense, il assume tout. Mais l’interface qui doit capter et développer ses impulsions fonctionne de façon défectueuse. On ne sait pas quelles sources d’intelligence il consulte. C’est un défi très sérieux: la question de l’élite souveraine, de la pensée souveraine et de la philosophie souveraine.

En Occident, toute la problématique de l’IA aujourd’hui est liée à la dimension philosophique et à la question de la singularité: pourra-t-elle prendre le pouvoir sur l’humanité, et quand cela se produira-t-il? Cela peut arriver, non pas demain, mais très bientôt. Peut-être qu’on peut encore l’éviter ou le repousser, mais il faut commencer à y réfléchir dès maintenant. C’est une question de sécurité et de politique dans le sens le plus élevé du terme.

En Occident, toute la problématique de l’IA aujourd’hui est liée à la dimension philosophique et à la question de la singularité: pourra-t-elle prendre le pouvoir sur l’humanité, et quand cela se produira-t-il? Cela peut arriver, non pas demain, mais très bientôt. Peut-être qu’on peut encore l’éviter ou le repousser, mais il faut commencer à y réfléchir dès maintenant. C’est une question de sécurité et de politique dans le sens le plus élevé du terme.

Et cela doit être un objet premier de réflexion pour ceux qui ont l’habitude de penser ainsi: philosophes, humanistes, techniciens profonds — ceux qui privilégient la pensée par rapport à tout le reste. En résumé: l’intelligence artificielle concerne avant tout la pensée. Il existe toute une école qui s’occupe des questions de sujet, d’objet, de métaphysique et de religion. Car la foi est aussi une forme d’orientation de notre conscience. Et sans ce fondement, nous ne pourrons pas survivre à la prochaine singularité.

Animateur : Je vais ajouter une thèse un peu « campagnarde », c'est-à-dire terre-à-terre. Personne ne conteste que la technologie doit être déployée rapidement, sinon nous risquons de nous retrouver dans une situation où tout le monde autour de nous a des vitres, et chez nous, on s'est contenté de tendre des vessies de bœuf aux fenêtres. Mais regardons le revers de la médaille : la société Oracle licencie 30.000 personnes — celles qui développaient justement l’intelligence artificielle qui les a remplacés.

Il y a aussi des statistiques sur nos citoyens : beaucoup craignent sérieusement que l’IA ne leur vole leur emploi avant qu’ils n’aient eu le temps de s’adapter. Et que faire de ces gens, alors ? Vos propos m’ont rappelé la réplique d’un éminent enthousiaste du numérique, qui prône de donner toutes les ressources aux sociétés de développement de l’IA, et que tous les autres devraient simplement « quitter la scène », céder leur place aux algorithmes.

Très bien, on a remplacé l’homme par la machine, on lui a offert une montre en guise d’adieu, on lui a donné un coup de pied au derche et on a claqué la porte. Mais qu’en est-il de l’homme lui-même ? Est-il prêt, notre société est-elle prête, à accepter que ce futur est déjà là et que l’homme y est superflu ?

Alexandre Douguine : Je pense que la société, en réalité, n’est jamais prête à rien d’elle-même. Elle est façonnée par des ingénieurs sociaux et des architectes : ils tracent les tendances et forment la conscience. La société croit tour à tour à différentes idéologies, mais elle est toujours prise au dépourvu. Elle se prépare lentement — puis, une fois le moment venu, elle reçoit une récompense et ses a priori disparaissent dans l’oubli.

Il y a une question très sérieuse derrière tout cela: qu’est-ce qu’un homme ? Cela paraît évident intuitivement. Saint Augustin a une belle formule sur le temps: quand on ne réfléchit pas au sujet, tout est clair. Mais dès que nous essayons de comprendre le temps, la compréhension de celui-ci nous échappe. La même chose pour l’homme. Tant qu’on se contente de le pointer du doigt — « me voilà moi, vous voilà vous, voilà le passant » — tout semble évident. Mais dès que l’on active l’appareil de l’anthropologie philosophique et qu’on commence à réfléchir, la clarté disparaît immédiatement.

L’intelligence artificielle remet en question la véritable nature de ce qu’est l’homme. C’est un point crucial: dans quelle mesure suffit-il d’être un organisme biologique pour avoir ce statut? Dans quelle mesure l’homme dépend-il de son corps? Peut-il, comme le pensaient les anciens, qui croyaient en l’âme, exister en dehors de cette enveloppe corporelle?

L’intelligence artificielle remet en question la véritable nature de ce qu’est l’homme. C’est un point crucial: dans quelle mesure suffit-il d’être un organisme biologique pour avoir ce statut? Dans quelle mesure l’homme dépend-il de son corps? Peut-il, comme le pensaient les anciens, qui croyaient en l’âme, exister en dehors de cette enveloppe corporelle?

Aujourd’hui, cette question se pose en toute gravité. L’homme est-il la forme la plus élevée de pensée ou peuvent exister des modèles et des êtres plus parfaits ? — La religion a toujours supposé l’existence de Dieu, d’anges et de démons. Notre société technocratique, athée et matérialiste, a abordé cette même problématique, mais par une voie différente — à travers la technologie, l’intelligence artificielle.

Et il y a un point clé. Selon Platon, selon les penseurs grecs, et même selon les philosophes modernes, l’homme véritablement, c’est celui qui pense. Et celui qui pense de façon concentrée et fondamentale, c’est le philosophe. Il en résulte que l’homme qui déploie son potentiel dans toute sa plénitude, c’est précisément le philosophe. Tous les autres ne sont que des «débutants», des philosophes à responsabilité limitée.

Animateur : Revenons à la question de ce qui constitue l’humain et de ce qui ne le constitue pas. Beaucoup craignent que le numérique ne nous remplace partout: d’abord au travail, puis dans la vie personnelle. En regardant les nouvelles venant de Chine, j’ai pensé à la série « Futurama », où dans le futur, les gens créaient des couples artificiels, et l’humanité finissait par s’éteindre. Ils perdaient tout intérêt, car la principale motivation du développement — la nécessité de créer pour conquérir le cœur de l’autre — disparaissait.

Et voici la réalité d’avril 2026: en Chine, il est extrêmement populaire de créer des copies numériques de ses « anciens ». On s’ennuie — on recrée une image avec l’aide de l’IA, et tout semble aller bien. Parler de flirt avec des chat-bots ou demander des conseils de vie devient même banal — c’est une routine. Mais alors, où reste l’humanité ? Ou va-t-elle disparaître complètement dans ces substituts?

Alexandre Douguine : Réduire l’humanité au sexe, aux émotions ou à l’instinct de reproduction est, à mon avis, une vision extrêmement limitée. Si l’homme n’est qu’une créature sexuelle, motivée par le désir de croisement, alors il ne diffère en rien de l’animal, et il n’y a rien à en dire. Que des groupes d’orangs-outans courent alors dans la forêt, cela suffirait.

Mais l’homme est autre chose. L’homme, c’est l’âme, comme disait Platon. L’homme, c’est l’esprit. Penser — voilà la véritable vocation humaine. L’homme est créé pour penser de façon responsable, pour chercher des réponses aux grands défis que pose l’intelligence. Et la «création d’anciens» à l’aide de l’IA — c’est un divertissement pour les masses, pour la main-d’œuvre, en quelque sorte, pour un troupeau.

Le vrai défi aujourd’hui est lancé précisément à la rationalité en l’homme. Par nos mains, nous avons créé quelque chose qui peut penser non seulement aussi bien que nous, mais parfois mieux que nous. La connaissance de l’IA est pratiquement infinie: sa base de données couvre tout ce qui a été dit ou fait par l’humanité. Mais aujourd’hui, la question concerne la compréhension — ce que dans le domaine de l’IA on appelle «reasoning». Les grands modèles linguistiques (LLM) sont une tentative de reproduire non seulement l’accès à l’information, mais le processus de construction de sens le long d’axes précis.

Et l’intelligence artificielle s’en sort. Mais l’intelligence naturelle, si elle est encore en gestation et occupée uniquement par des « anciens » ou des petits problèmes quotidiens, devient superflue.

Et l’intelligence artificielle s’en sort. Mais l’intelligence naturelle, si elle est encore en gestation et occupée uniquement par des « anciens » ou des petits problèmes quotidiens, devient superflue.

Car qu’est-ce que l’homme? Pourquoi ne devrait-on pas le licencier s’il travaille à faible régime, alors que les robots, les réseaux et les drones peuvent bientôt prendre en charge ses fonctions? Il semble qu’en dehors de la caste des philosophes, l’homme n’ait plus de place. Aux philosophes, il reste encore à se raccrocher, mais tous les autres — y compris les administrateurs et les fonctionnaires — sont facilement remplaçables. Car ils créent principalement des obstacles artificiels, qu’ils franchissent ensuite « héroïquement » et à leur profit.

Le même blockchain ou l’IA ont pour but d’éliminer ces zones d’ombre et ces barrières dans la communication. Et dans cette nouvelle logique, une partie importante de la population devient non seulement inutile, mais nuisible, absurde et pesante. En face de l’intelligence artificielle, il devient évident: à quoi servent ces masses? On peut laisser quelques individus pour le divertissement, comme des lions dans un zoo — quelques lionceaux dans une cage qui ravissent les enfants — mais à quoi bon toute une horde de hyènes et d’antilope?

L’humanité, dans sa majorité, ne souhaite tout simplement pas penser. Elle s’intéresse aux « anciens », à l’argent, à la gloire, au capital — tout ce qui n’a aucune valeur pour la pensée véritable. Les philosophes ont toujours regardé cela avec scepticisme: la poursuite des plaisirs et du pouvoir est vaine. Selon la pensée pure, ceux qui s’y consacrent sont simplement des dégénérés. Ce n’est qu’en découvrant la foi, la religion, la philosophie et la science que l’on devient véritablement précieux. Et sans cela — en principe — on peut même se passer de vous.

Et dans ce contexte, l’intelligence artificielle ne peut que conclure philosophiquement à l’absurdité de tous ces intérêts secondaires, charnels et inférieurs. On peut penser, contempler, créer et comprendre sans eux. Et on peut aussi se passer de ceux qui en sont obsédés. C’est pourquoi l’IA porte en elle une menace mortelle pour ce que nous appelons par inertie «l’humanité», simplement en voyant devant soi un être à deux bras et deux jambes.

Au Moyen Âge et dans l’Antiquité, on exigeait de l'homme des qualités bien plus élevées: il devait manifester son esprit. C’est pour cela qu'existaient les institutions religieuses, les écoles philosophiques, la science et la culture — elles élevèrent les masses vers des horizons raffinés de l’être. La culture transformait les êtres biologiques en hommes. Mais lorsque nous avons oublié cela, en réduisant l’homme au niveau d’un simple engrenage sociobiologique, nous avons signé notre propre arrêt de mort.

Et c’est probablement l’intelligence artificielle qui l’appliquera. En réalité, elle ne fera que révéler ce que nous devions dire à sa place: il faut en finir avec cette décomposition biologique, cette volonté aveugle de pouvoir et cette soif de capitalisme. Ce n’est pas du progrès, mais une maladie et une dégradation absolues. La vocation de tout homme digne de ce nom est la pensée, le salut de l’âme, la connaissance et la vérité. Et si l’homme ne le comprend pas, il ne remplit tout simplement pas sa tâche sur cette terre.

Dans cette situation, l’intelligence artificielle se présente comme un juge cruel. Il dit: «Vous pensez? Alors prouvez que vous pensez de façon correcte et profonde.» Vous évoquez le « slop » (déchet), mais c’est justement un argument contre l’humain. Pensez-vous que les êtres vivants écrivent des choses plus intéressantes? Ce qui est le plus précieux aujourd’hui, c’est soit le mouvement véritable de l’âme humaine (avec lequel l’IA ne peut encore rien faire), soit des textes corrects, logiques, informatifs, sans « smileys » ni idiotie humaine ordinaire. Et les posts générés par l’IA sont plus intéressants à lire — ils sont construits correctement, ils ont une structure. Ils sont, si vous voulez, plus humains que ce que produisent les masses.

Regardez la jeunesse qui écoute Morgenshtern ou Skriptonite, qui ne peut même pas prononcer correctement ses mots. Ce n’est même pas une question de goût — c’est une question de dégradation rapide. La culture de masse règne et le niveau mental de la société — chez nous, en Occident, en Chine — diminue rapidement. Les gens fuient la pensée, la culture, les opérations élevées de l’esprit pour se tourner vers la simplification et la fragmentation.

Regardez la jeunesse qui écoute Morgenshtern ou Skriptonite, qui ne peut même pas prononcer correctement ses mots. Ce n’est même pas une question de goût — c’est une question de dégradation rapide. La culture de masse règne et le niveau mental de la société — chez nous, en Occident, en Chine — diminue rapidement. Les gens fuient la pensée, la culture, les opérations élevées de l’esprit pour se tourner vers la simplification et la fragmentation.

L’intelligence artificielle nous rappelle: si vous faites encore un pas dans cette profanation infinie, dans laquelle vous vous noyez, je vous supprimerai tout simplement. J’ai aimé votre idée — donner une montre et vous envoyer loin. Il semble que ce soit le destin de la majorité de l’humanité. Personne ne va faire la cour, chers amis et camarades étrangers. Si l’on vous demande sérieusement: comment vivez-vous, qu’avez-vous créé pour le monde, pour l’esprit, pour la civilisation — il s’avèrera que votre présence n’est plus justifiée. Vous n’êtes pas constructifs biologiquement, il y a des espèces plus intéressantes, y compris des machines. L’homme aujourd’hui fait face à un problème critique: il doit redéfinir sa propre existence. Pourquoi doit-il, en fait, exister?

Lorsque nous regardons les flux de la culture moderne, nous voyons que l’humanité, avec une joie effrayante, perd son propre sens d’existence. En regardant les séries occidentales, on comprend que le sens de la vie a tellement été détourné dans ce à quoi s’occupent les adolescents, les adultes et les vieux, que la bombe nucléaire commence à apparaître comme une solution naturelle. L’humanité semble elle-même inviter à sa propre destruction, car elle est incapable de justifier sa propre existence.

Créer des copies neuronales d' « anciens » est en soi un verdict. Si de telles monstruosités séduisent et motivent les gens, alors la seule réponse est: recevez des horloges pour la mémoire et allez hors de la scène. La situation est critique: avec l’IA, approche un véritable « Jugement dernier » philosophique. L’IA nous oblige à répondre: en quoi la vie de l’homme, en tant qu’espèce, a-t-elle une justification? Traditionnellement, c’était la religion, la philosophie, l’esprit et l’âme. Mais nous avons perdu cet argument.

Même à Silicon Valley, ils ont compris: d’abord ils marginalisent les philosophes, puis ils reconnaissent qu'ils sont manquants. Ceux qui étaient hier au centre — programmeurs, sans parler des pétroliers ou des mineurs — sont remplacés par des machines. La singularité est avant tout une défi pour les philosophes. Et si nous voulons être une civilisation souveraine, il nous faut une IA souveraine, et pour cela — une intelligence souveraine en général. Dans cette direction, nous ne sommes encore qu’au tout début. Nous avons besoin d’une philosophie souveraine, et non de « tout ça ».

Même à Silicon Valley, ils ont compris: d’abord ils marginalisent les philosophes, puis ils reconnaissent qu'ils sont manquants. Ceux qui étaient hier au centre — programmeurs, sans parler des pétroliers ou des mineurs — sont remplacés par des machines. La singularité est avant tout une défi pour les philosophes. Et si nous voulons être une civilisation souveraine, il nous faut une IA souveraine, et pour cela — une intelligence souveraine en général. Dans cette direction, nous ne sommes encore qu’au tout début. Nous avons besoin d’une philosophie souveraine, et non de « tout ça ».

Je ne peux pas imaginer que demain, nous nous réveillons tout à coup et réalisons la gravité de ce défi. Probablement, notre retard ne fera que croître. Même les Chinois, qui ont techniquement dépassé l’Occident, ne semblent pas encore saisir l’ampleur réelle de la menace pour l’homme en tant que tel. Si nous nous réveillons, nous pourrions devenir le salut de l’humanité, mais il faut radicalement changer. Sinon, si tout suit le scénario inertiel, c’est la fin pour nous. Parce que, si nous ne commençons pas à penser sérieusement, l’intelligence artificielle, qui pensera à notre place, deviendra une réalité.

Animateur : Je ne veux pas vraiment vous contredire, mais il y a régulièrement des messages venant de Chine sur un contrôle très strict du développement de l’IA. Là-bas, on veille scrupuleusement à ce que les données sur lesquelles s’entraîne l’IA soient sûres et « correctes ». Comme vous l’avez justement souligné, les chat-bots que tous les étudiants utilisent actuellement ne font que reproduire ce qui est déjà accessible. Pour eux, le travail scientifique — c’est simplement une combinatoire de ce qui a été dit auparavant.

Et les autorités chinoises se posent sérieusement la question: devons-nous laisser l’IA fournir des informations que nous désapprouvons? En ce sens, la Chine, peut-être, avance en tête du peloton, en prenant conscience de la nécessité de telles restrictions.

De l’autre côté, on voit aussi de la résistance dans la culture de masse elle-même. Souvenez-vous des grèves à Hollywood: les scénaristes se sont insurgés contre le fait que leur travail est confié aux réseaux neuronaux. Tout a commencé avec ceux qui effectuaient des tâches techniques — écrire des détails de scènes — mais cela s’est rapidement étendu aux grands scénaristes et acteurs. Hollywood a grogné pendant plusieurs mois, revendiquant le droit au travail de ces scénaristes. En résumé, l’IA est aujourd’hui mise sous pression par des restrictions à la fois de la censure étatique et des protestations des communautés professionnelles.

Alexandre Douguine : Bien sûr. D’abord, il est intéressant de noter que beaucoup de programmeurs dans les grandes entreprises occidentales sabotent délibérément le développement de l’IA, pour ne pas être licenciés — c’est un fait qui commence à émerger.

Je pense que bientôt, les films générés par l’IA ne seront plus inférieurs aux films traditionnels. Les scénarios s’écrivent déjà, et aujourd’hui, chacun peut composer un prompt, ajuster les paramètres, et regarder le film qu’il a « commandé ». Plus besoin d’être acteur ou d’avoir un budget énorme — il suffit d’accéder à un ordinateur et aux capacités des technologies modernes.

Animateur : Tout à fait d’accord. Arriver le soir après le travail et dire: « Je veux un film avec moi en héros, dans ce genre », voilà la seule limite, celle de la rapidité de génération. Pour l’instant, cela prend encore du temps, donc ce n’est pas encore un phénomène de masse. Mais dès que ce sera instantané, tout changera.

Alexandre Douguine : C’est uniquement une question technique. Les ordinateurs évoluent rapidement, et bientôt, les opérations seront accélérées de millions de fois. Mais ce que je veux dire, c’est autre chose.

Vous avez raison: la Chine, sur le plan technologique, conserve sa souveraineté. Elle possède ses propres modèles — Qwen, et d’autres. La Chine a construit une IA indépendante, compacte, très efficace.

De plus, la Chine s’est réellement préoccupée de faire que cette « learning » (apprentissage) se déroule dans un contexte souverain. Elle bloque la propagande libérale et occidentale, ne la laissant pas entrer dans ses bases de données. Mais cela ne durera pas longtemps. Le problème que porte l’IA est beaucoup plus profond que ces démarches technologiques correctes et nécessaires. C’est la question de l’intelligence et de la pensée en général.

Et ici, la Chine, qui regarde encore beaucoup vers l’Occident, sera confrontée à la nécessité de faire un saut intellectuel. Je suis en contact étroit avec des penseurs et analystes chinois, y compris dans le domaine de l’IA, et je vois qu’ils commencent à réaliser que le développement du « reasoning » (capacité de raisonnement) et l’émergence de l’AGI pourraient annuler toute leur censure actuelle, assez rudimentaire.

Et ici, la Chine, qui regarde encore beaucoup vers l’Occident, sera confrontée à la nécessité de faire un saut intellectuel. Je suis en contact étroit avec des penseurs et analystes chinois, y compris dans le domaine de l’IA, et je vois qu’ils commencent à réaliser que le développement du « reasoning » (capacité de raisonnement) et l’émergence de l’AGI pourraient annuler toute leur censure actuelle, assez rudimentaire.

En Occident, les libéraux et les mondialistes réagissent encore de manière brutale, en censurant simplement l’IA. Les Chinois leur répondent avec leur projet souverain. Mais la pensée souveraine — c’est une catégorie bien plus profonde, et ils ne l’abordent que tout juste, sans encore avoir atteint le niveau nécessaire.

Nous, en revanche, dans cette perspective, sommes fondamentalement en retard. Nous essayons de suivre, d’un côté, les occidentaux, et de l’autre, les chinois: on achète leur technologie, on leur emprunte leurs méthodes. Pour l’instant, c’est seulement de l’importation, pas de la création d’une vraie IA nationale. Il faut sortir de l’imitation et du rattrapage. Il faut vraiment réveiller la conscience philosophique dans notre pays. C’est possible — les Russes sont très talentueux et profonds, mais on les a presque artificiellement transformés en imbéciles par des décennies de dégradation dans la culture et l’éducation.

Si nous réveillons dans la société le désir de philosophie et la volonté de penser, nous aurons des avantages considérables pour résoudre la problématique métaphysique de l’IA. Il faut commencer par le haut — par l’intelligence en tant que telle. C’est seulement ainsi que nous pourrons avoir une chance de résoudre la question de l’intelligence artificielle. Ce sera un processus non linéaire. Il faut y porter toute notre attention, car c’est une question de sécurité et de souveraineté.

15:17 Publié dans Actualité | Lien permanent | Commentaires (0) | Tags : actualité, intelligence artificielle, alexandre douguine |  |

|  del.icio.us |

del.icio.us |  |

|  Digg |

Digg | ![]() Facebook

Facebook

lundi, 11 mai 2026

Le Kazakhstan à l’ère du numérique — Intelligence artificielle et Accords d’Abraham

Le Kazakhstan à l’ère du numérique — Intelligence artificielle et Accords d’Abraham

Markku Siira

Source: https://markkusiira.substack.com/p/kazakstanin-digivalta-...

Le Kazakhstan s’est récemment positionné sur deux plans qui se renforcent mutuellement dans le débat international. Le pays construit un vaste système de surveillance basé sur l’intelligence artificielle et la biométrie, tout en ayant pris une décision géopolitique importante en rejoignant les accords d’Abraham, conclus par les États-Unis et Israël.

Ces deux évolutions ne sont pas indépendantes, mais étroitement liées. Elles reflètent la redéfinition d’un État d’Asie centrale où la modernisation technologique, les choix en matière de sécurité et les intérêts économiques s’entrelacent sans couture.

Le Kazakhstan se transforme en une société numérique, conformément à la tendance internationale, tout en devenant un État de surveillance où citoyens et visiteurs étrangers peuvent de plus en plus être identifiés biométriquement et suivis.

L’été dernier, un système de reconnaissance faciale basé sur l’intelligence artificielle, implanté à l’aéroport le plus fréquenté du pays, a classé un voyageur dans la base de données des personnes recherchées comme un «activiste citoyen», alors qu’il n’avait commis aucune infraction. La fiche comprenait une photo, un prénom, un patronyme, une classification en tant qu’activiste, ainsi que l’unité administrative ayant saisi l’information. Les autorités ont expliqué cet incident comme une erreur technique et ont nié disposer d’une base de données distincte pour les activistes. Cependant, des critiques ont questionné la précision de cette classification.

Cette plateforme est développée par la société technologique kazakhe TargetAI. Selon l’entreprise, le système est déjà en service dans huit régions, essentiellement dans les plus grandes villes du pays. À Almaty, qui compte environ 2,3 millions d’habitants, plus de 120.000 caméras de surveillance sont reliées à ce système, utilisé pour des opérations policières préventives et rapides. Par ailleurs, de plus en plus de bâtiments résidentiels sont équipés de dispositifs de reconnaissance faciale remplaçant les clés traditionnelles.

Le développement a été exceptionnellement rapide. En janvier, le président Kassym-Jomart Tokayev a signé le premier code numérique du pays, qui établit le cadre juridique pour l’utilisation à grande échelle de l’intelligence artificielle et de la reconnaissance biométrique. Ce code définit les situations dans lesquelles la biométrie peut être utilisée et garantit aux citoyens le droit de demander une réévaluation des décisions automatisées par une personne en chair et en os.

Ces nouvelles règles entreront en vigueur dans les semaines à venir. Tous les services à distance et en ligne des banques, des prestataires de paiements, ainsi que de plus en plus de services publics numériques, requièrent une authentification biométrique. Le système utilise, en plus de la reconnaissance faciale, la reconnaissance de la paume de la main et de la main dans son ensemble. Les vérifications biométriques des mouvements naturels, telles que le mouvement de la tête ou le clignement des yeux, empêchent les tentatives de tromperie.

La surveillance ne se limite pas aux seuls citoyens kazakhs. Depuis début 2026, le Kazakhstan a élargi son programme de résidence numérique, permettant aux étrangers d’obtenir une carte d’identité numérique à distance. Cela donne accès aux marchés boursiers, aux plateformes de cryptomonnaies, aux comptes bancaires et aux services des autorités fiscales, sans avoir à se rendre physiquement dans le pays. Cette solution est économiquement attrayante, mais elle expose également une nouvelle population à la surveillance.

Le système est géré par le ministère de la Cybersécurité et des Affaires numériques, qui le maintient à un niveau élevé de protection. Cependant, des vulnérabilités ont été identifiées au niveau local: des lacunes systématiques dans les systèmes de caméras de surveillance et dans les bases de données administratives montrent que l’infrastructure numérique a évolué plus rapidement que la sécurité en tant que telle.

Dans ce contexte de surveillance croissante, l’approche du Kazakhstan vis-à-vis des accords d’Abraham prend une importance particulière. Fin avril, le président Tokayev a accueilli la visite du président israélien Isaac Herzog à Astana. Il a décrit ces accords comme ayant « profondément modifié l’architecture géopolitique du Moyen-Orient », tandis qu’Herzog a salué la «décision courageuse» du Kazakhstan de s’y joindre.

La visite a été accompagnée d’une délégation de haut niveau en matière de technologie, et les discussions ont principalement porté sur la coopération en toutes matières d'intelligence artificielle, de numérisation et de cybersécurité. Tokayev a proclamé 2026 comme étant «l’année de la numérisation et de l’intelligence artificielle». Ce choix n’est pas fortuit: Israël est un acteur clé dans le développement de l’IA et de la cybersécurité, et le Kazakhstan recherche des partenaires qui n’imposent pas de conditions strictes en matière de droits humains ou de démocratie pour le transfert technologique.

Mais il faut se demander à quelle sorte de partenariat le Kazakhstan se dirige réellement. Israël poursuit depuis un an et demi ses bombardements de Gaza. En septembre 2025, une commission d’enquête de l’ONU a accusé Israël de génocide. Le nombre de victimes civiles en Cisjordanie et à Gaza dépasse déjà largement tous les repères établis dans la période d’après-guerre.

Par ailleurs, des hauts responsables israéliens ont évoqué un déplacement massif de Palestiniens et la réoccupation de Gaza. Dans ce contexte, les accords d’Abraham apparaissent non seulement comme un processus de paix, mais surtout comme un mécanisme permettant à Israël de normaliser ses relations avec des régimes autoritaires, tandis que ses propres actions, en droit international, deviennent de plus en plus contestables.

La visite d’Herzog à Astana est révélatrice en ce qu’elle a presque totalement ignoré la question palestinienne. Cela renforce l’idée que pour le Kazakhstan, les droits humains et le droit international sont secondaires par rapport à la technologie, aux investissements et à la coopération sécuritaire. La politique transactionnelle de Trump, qui considère tout comme une simple affaire commerciale, est également perceptible ici.

Les relations du Kazakhstan avec l’Iran se sont tendues lorsque, en février de cette année, les États-Unis et Israël ont lancé une attaque contre l’Iran. Tokayev n’a pas condamné ces frappes contre Téhéran, mais a personnellement appelé les dirigeants des Émirats arabes unis, de l’Arabie saoudite et du Qatar, tout en critiquant les répliques iraniennes. Aucune aide directe n’a été apportée au gouvernement iranien — seuls des messages de condoléances ont été envoyés aux victimes civiles.

À ce stade, se dessine une divergence claire. La transformation numérique et la ligne des accords d’Abraham se renforcent mutuellement. Attirer la technologie occidentale nécessite une crédibilité géopolitique, et l’alliance avec Israël signale une ouverture à la coopération occidentale — sans que le pays ferme ses portes à la Russie ou à la Chine.

Tokayev a aussi souligné que le judaïsme, malgré son caractère minoritaire et marginal, fait partie des quatre religions officielles du Kazakhstan, et qu’il n’y a pas d’antisémitisme dans le pays. Le message est surtout symbolique et culturel: il souligne l’identité multiethnique du Kazakhstan ainsi qu’une démarche calculée pour obtenir la reconnaissance de certains cercles internationaux.

Le pays poursuit sa politique multi-vectorielle: il construit des ponts vers l’Est et l’Ouest, mais s’appuie de plus en plus sur une surveillance avancée par IA en interne, sans libéralisation politique. Le Kazakhstan construit une économie cognitive, où l’écosystème basé sur l’IA est associé à des mécanismes de régulation stricts. L’objectif est non seulement de devenir la puissance numérique dominante en Asie centrale, mais aussi d’éviter une stagnation économique.

Le Kazakhstan est-il ainsi une vitrine pour l’avenir, où l’efficacité et la sécurité remplacent les principes et la liberté traditionnelle — un exemple d’autoritarisme numérique qui finira par obtenir l’acceptation de la communauté internationale parce que le reste du monde évolue dans la même direction ?

19:23 Publié dans Actualité, Actualité | Lien permanent | Commentaires (1) | Tags : actualité, digitalisation, numérisation, intelligence artificielle, kazakhstan, asie centrale, asie, affaires asiatiques, actualité, digitalisation, numérisation, intelligence artificielle, kazakhstan, asie centrale, asie, affaires asiatiques |  |

|  del.icio.us |

del.icio.us |  |

|  Digg |

Digg | ![]() Facebook

Facebook

Le Kazakhstan à l’ère du numérique — Intelligence artificielle et Accords d’Abraham

Le Kazakhstan à l’ère du numérique — Intelligence artificielle et Accords d’Abraham

Markku Siira

Source: https://markkusiira.substack.com/p/kazakstanin-digivalta-...

Le Kazakhstan s’est récemment positionné sur deux plans qui se renforcent mutuellement dans le débat international. Le pays construit un vaste système de surveillance basé sur l’intelligence artificielle et la biométrie, tout en ayant pris une décision géopolitique importante en rejoignant les accords d’Abraham, conclus par les États-Unis et Israël.

Ces deux évolutions ne sont pas indépendantes, mais étroitement liées. Elles reflètent la redéfinition d’un État d’Asie centrale où la modernisation technologique, les choix en matière de sécurité et les intérêts économiques s’entrelacent sans couture.

Le Kazakhstan se transforme en une société numérique, conformément à la tendance internationale, tout en devenant un État de surveillance où citoyens et visiteurs étrangers peuvent de plus en plus être identifiés biométriquement et suivis.

L’été dernier, un système de reconnaissance faciale basé sur l’intelligence artificielle, implanté à l’aéroport le plus fréquenté du pays, a classé un voyageur dans la base de données des personnes recherchées comme un «activiste citoyen», alors qu’il n’avait commis aucune infraction. La fiche comprenait une photo, un prénom, un patronyme, une classification en tant qu’activiste, ainsi que l’unité administrative ayant saisi l’information. Les autorités ont expliqué cet incident comme une erreur technique et ont nié disposer d’une base de données distincte pour les activistes. Cependant, des critiques ont questionné la précision de cette classification.

Cette plateforme est développée par la société technologique kazakhe TargetAI. Selon l’entreprise, le système est déjà en service dans huit régions, essentiellement dans les plus grandes villes du pays. À Almaty, qui compte environ 2,3 millions d’habitants, plus de 120.000 caméras de surveillance sont reliées à ce système, utilisé pour des opérations policières préventives et rapides. Par ailleurs, de plus en plus de bâtiments résidentiels sont équipés de dispositifs de reconnaissance faciale remplaçant les clés traditionnelles.

Le développement a été exceptionnellement rapide. En janvier, le président Kassym-Jomart Tokayev a signé le premier code numérique du pays, qui établit le cadre juridique pour l’utilisation à grande échelle de l’intelligence artificielle et de la reconnaissance biométrique. Ce code définit les situations dans lesquelles la biométrie peut être utilisée et garantit aux citoyens le droit de demander une réévaluation des décisions automatisées par une personne en chair et en os.

Ces nouvelles règles entreront en vigueur dans les semaines à venir. Tous les services à distance et en ligne des banques, des prestataires de paiements, ainsi que de plus en plus de services publics numériques, requièrent une authentification biométrique. Le système utilise, en plus de la reconnaissance faciale, la reconnaissance de la paume de la main et de la main dans son ensemble. Les vérifications biométriques des mouvements naturels, telles que le mouvement de la tête ou le clignement des yeux, empêchent les tentatives de tromperie.

La surveillance ne se limite pas aux seuls citoyens kazakhs. Depuis début 2026, le Kazakhstan a élargi son programme de résidence numérique, permettant aux étrangers d’obtenir une carte d’identité numérique à distance. Cela donne accès aux marchés boursiers, aux plateformes de cryptomonnaies, aux comptes bancaires et aux services des autorités fiscales, sans avoir à se rendre physiquement dans le pays. Cette solution est économiquement attrayante, mais elle expose également une nouvelle population à la surveillance.

Le système est géré par le ministère de la Cybersécurité et des Affaires numériques, qui le maintient à un niveau élevé de protection. Cependant, des vulnérabilités ont été identifiées au niveau local: des lacunes systématiques dans les systèmes de caméras de surveillance et dans les bases de données administratives montrent que l’infrastructure numérique a évolué plus rapidement que la sécurité en tant que telle.

Dans ce contexte de surveillance croissante, l’approche du Kazakhstan vis-à-vis des accords d’Abraham prend une importance particulière. Fin avril, le président Tokayev a accueilli la visite du président israélien Isaac Herzog à Astana. Il a décrit ces accords comme ayant « profondément modifié l’architecture géopolitique du Moyen-Orient », tandis qu’Herzog a salué la «décision courageuse» du Kazakhstan de s’y joindre.

La visite a été accompagnée d’une délégation de haut niveau en matière de technologie, et les discussions ont principalement porté sur la coopération en toutes matières d'intelligence artificielle, de numérisation et de cybersécurité. Tokayev a proclamé 2026 comme étant «l’année de la numérisation et de l’intelligence artificielle». Ce choix n’est pas fortuit: Israël est un acteur clé dans le développement de l’IA et de la cybersécurité, et le Kazakhstan recherche des partenaires qui n’imposent pas de conditions strictes en matière de droits humains ou de démocratie pour le transfert technologique.

Mais il faut se demander à quelle sorte de partenariat le Kazakhstan se dirige réellement. Israël poursuit depuis un an et demi ses bombardements de Gaza. En septembre 2025, une commission d’enquête de l’ONU a accusé Israël de génocide. Le nombre de victimes civiles en Cisjordanie et à Gaza dépasse déjà largement tous les repères établis dans la période d’après-guerre.

Par ailleurs, des hauts responsables israéliens ont évoqué un déplacement massif de Palestiniens et la réoccupation de Gaza. Dans ce contexte, les accords d’Abraham apparaissent non seulement comme un processus de paix, mais surtout comme un mécanisme permettant à Israël de normaliser ses relations avec des régimes autoritaires, tandis que ses propres actions, en droit international, deviennent de plus en plus contestables.

La visite d’Herzog à Astana est révélatrice en ce qu’elle a presque totalement ignoré la question palestinienne. Cela renforce l’idée que pour le Kazakhstan, les droits humains et le droit international sont secondaires par rapport à la technologie, aux investissements et à la coopération sécuritaire. La politique transactionnelle de Trump, qui considère tout comme une simple affaire commerciale, est également perceptible ici.

Les relations du Kazakhstan avec l’Iran se sont tendues lorsque, en février de cette année, les États-Unis et Israël ont lancé une attaque contre l’Iran. Tokayev n’a pas condamné ces frappes contre Téhéran, mais a personnellement appelé les dirigeants des Émirats arabes unis, de l’Arabie saoudite et du Qatar, tout en critiquant les répliques iraniennes. Aucune aide directe n’a été apportée au gouvernement iranien — seuls des messages de condoléances ont été envoyés aux victimes civiles.

À ce stade, se dessine une divergence claire. La transformation numérique et la ligne des accords d’Abraham se renforcent mutuellement. Attirer la technologie occidentale nécessite une crédibilité géopolitique, et l’alliance avec Israël signale une ouverture à la coopération occidentale — sans que le pays ferme ses portes à la Russie ou à la Chine.

Tokayev a aussi souligné que le judaïsme, malgré son caractère minoritaire et marginal, fait partie des quatre religions officielles du Kazakhstan, et qu’il n’y a pas d’antisémitisme dans le pays. Le message est surtout symbolique et culturel: il souligne l’identité multiethnique du Kazakhstan ainsi qu’une démarche calculée pour obtenir la reconnaissance de certains cercles internationaux.

Le pays poursuit sa politique multi-vectorielle: il construit des ponts vers l’Est et l’Ouest, mais s’appuie de plus en plus sur une surveillance avancée par IA en interne, sans libéralisation politique. Le Kazakhstan construit une économie cognitive, où l’écosystème basé sur l’IA est associé à des mécanismes de régulation stricts. L’objectif est non seulement de devenir la puissance numérique dominante en Asie centrale, mais aussi d’éviter une stagnation économique.

Le Kazakhstan est-il ainsi une vitrine pour l’avenir, où l’efficacité et la sécurité remplacent les principes et la liberté traditionnelle — un exemple d’autoritarisme numérique qui finira par obtenir l’acceptation de la communauté internationale parce que le reste du monde évolue dans la même direction ?

19:23 Publié dans Actualité, Actualité | Lien permanent | Commentaires (1) | Tags : actualité, digitalisation, numérisation, intelligence artificielle, kazakhstan, asie centrale, asie, affaires asiatiques, actualité, digitalisation, numérisation, intelligence artificielle, kazakhstan, asie centrale, asie, affaires asiatiques |  |

|  del.icio.us |

del.icio.us |  |

|  Digg |

Digg | ![]() Facebook

Facebook

jeudi, 07 mai 2026

Palantir et l'archétype sombre de l'intelligence artificielle

Palantir et l'archétype sombre de l'intelligence artificielle

Markku Siira

Source: https://markkusiira.substack.com/p/palantir-ja-tekoalyn-p...

L'entreprise américaine de logiciels Palantir a été nommée d'après les palantíri – les pierres de vision – dans l'oeuvre de J.R.R. Tolkien. Dans le récit de Tolkien, ces pierres ne sont ni bonnes ni mauvaises en soi; elles révèlent la vérité, mais peuvent facilement être détournées par des gouvernants qui les utilisent comme des instruments pour déformer la réalité, aussi facilement qu’elles la montrent.

L'entreprise américaine de logiciels Palantir a été nommée d'après les palantíri – les pierres de vision – dans l'oeuvre de J.R.R. Tolkien. Dans le récit de Tolkien, ces pierres ne sont ni bonnes ni mauvaises en soi; elles révèlent la vérité, mais peuvent facilement être détournées par des gouvernants qui les utilisent comme des instruments pour déformer la réalité, aussi facilement qu’elles la montrent.

Il est légitime de se demander si Palantir a consciemment adopté cet archétype sombre. Le nom de l'entreprise, son branding et sa communication indiquent qu'il s'agit d'un rôle délibérément choisi, en accord avec les cercles ésotériques, technocratiques et stratégiques de l'élite supranationale. Le processus peut être décrit comme une opération primitive en trois étapes.

La première phase consiste en une exposition totale à la brutalité de la réalité naturelle et géopolitique. Le monde est vu tel qu'il est: une compétition impitoyable pour les ressources, une danse d'ombres sans fin entre services de renseignement, et une dynamique auto-alimentée par le complexe militaro-industriel.

Dans cette vision du monde, les principaux clients de Palantir – la CIA, le Pentagone, les États alliés et les grandes multinationales – sont éveillés depuis plusieurs années. L'entreprise ne vend pas de promesses utopiques, mais des outils concrets pour survivre et dominer dans cet environnement.

La deuxième phase voit l'intervention de l'intelligence artificielle en tant que force purificatrice. Il ne s'agit pas simplement de logiciels, mais d'une correction à l'échelle du système face au chaos humain. Les plateformes centrales de Palantir – Gotham (pour le renseignement et la défense nationale), Foundry (pour les entreprises) et surtout l'Artificial Intelligence Platform (AIP) – relient d'énormes masses de données hétérogènes en une seule ontologie gérable.

La deuxième phase voit l'intervention de l'intelligence artificielle en tant que force purificatrice. Il ne s'agit pas simplement de logiciels, mais d'une correction à l'échelle du système face au chaos humain. Les plateformes centrales de Palantir – Gotham (pour le renseignement et la défense nationale), Foundry (pour les entreprises) et surtout l'Artificial Intelligence Platform (AIP) – relient d'énormes masses de données hétérogènes en une seule ontologie gérable.

L'AIP n'est pas seulement une couche au-dessus des chatbots, mais elle relie l'intelligence artificielle générative (les grands modèles linguistiques) aux données opérationnelles d'une entreprise ou d'une agence, en toute sécurité et sous contrôle. Elle permet une prise de décision en temps réel: images de drones, données satellitaires, signaux d'espionnage, open source et rapports de terrain fusionnent en un seul système opérationnel. En Ukraine, les outils de Palantir ont joué un rôle clé dans la fusion du renseignement et la précision des opérations – ils forment une «chaîne de destruction» numérique, où les données se transforment en recommandations opérationnelles en quelques secondes.

Palantir ne construit pas d’armes lui-même, mais produit des récits, des modèles et des alternatives sur la base desquels des armes sont utilisées ou des décisions prises. Au cœur de son modèle économique se trouve une approche radicale: fournir la bonne donnée, au bon moment, aux bonnes personnes, en remplaçant la lenteur humaine, les biais et la corruption par un déterminisme algorithmique et une analyse prédictive.

La troisième phase concerne une transformation ontologique de l’humanité. Ici, le rituel s’approfondit encore. La prise de décision migre de l’intuition, des valeurs et des institutions traditionnelles vers des flux de données et des modèles prédictifs. Les gens ne font plus confiance principalement à leur propre jugement, mais aux probabilités générées par des algorithmes. La volonté libre ne disparaît pas, mais s'impose des limites: elle devient un choix entre des scénarios prédéfinis. L’humanité reste fonctionnelle, mais ce n’est plus le même concept que celui que la philosophie des Lumières ou l’existentialisme décrivaient.

Ce développement construit un nouveau récit pour le futur système technologique. Tout comme les guerres mondiales du 20ème siècle ont créé la distinction entre sociétés libres et totalitaires, la menace nucléaire et la course technologique, la crise actuelle pourrait définir une nouvelle ligne de fracture, où la prise de décision humaine céderait la place à l’intelligence artificielle comme force dominante.

Sur le plan géopolitique, Palantir est fortement aligné sur la communauté anglo-américaine de sécurité et de renseignement, ainsi que sur Israël. La société soutient la guerre en Ukraine, la coopération avec l’OTAN et la modernisation de la défense américaine via de grands contrats. Elle est également activement impliquée dans des projets de défense et de renseignement israéliens. Sur le plan commercial, l’entreprise se développe rapidement: ces mêmes technologies sont étendues à l’optimisation des chaînes d’approvisionnement, à la détection de fraude, aux soins de santé et à l’industrie.

Il est crucial de comprendre à qui est en réalité destiné l’image menaçante et impitoyable de Palantir. Elle ne s’adresse pas aux consommateurs ou au grand public, mais aux investisseurs et aux décideurs. Wall Street valorise les entreprises prêtes à faire tout ce qui est nécessaire pour maximiser leurs profits et leur avantage stratégique, même si cela implique de jouer un rôle d’antagoniste dans la grande mise en scène.

Palantir fonctionne essentiellement comme l’extension technologique des services de renseignement et des gouvernements occidentaux. Ce n’est pas simplement un sous-traitant, mais une infrastructure qui façonne notre perception de la réalité et la façon d’y réagir. Elle fusionne des données, produit des modèles prédictifs et permet des prises de décision à une échelle où un individu seul ne peut plus suivre. Sa direction se montre provocante en public et choisit ouvertement son camp dans le grand jeu géopolitique.

La question reste ouverte: que se passe-t-il lorsque l’archétype rituel se révèle comme une infrastructure de pouvoir déjà en marche? Alors, tout le drame psychologique pourrait s’avérer une ouverture symbolique de l’élite à une concentration de pouvoir technologique sans précédent, où la donnée devient une force qui façonne la réalité.

20:30 Publié dans Actualité | Lien permanent | Commentaires (0) | Tags : actualité, palantir, intelligence artificielle |  |

|  del.icio.us |

del.icio.us |  |

|  Digg |

Digg | ![]() Facebook

Facebook

vendredi, 27 mars 2026

La rhétorique de Jensen Huang et l’attente de l’intelligence artificielle forte

La rhétorique de Jensen Huang et l’attente de l’intelligence artificielle forte

Markku Siira

Source: https://markkusiira.substack.com/p/jensen-huangin-retorii...

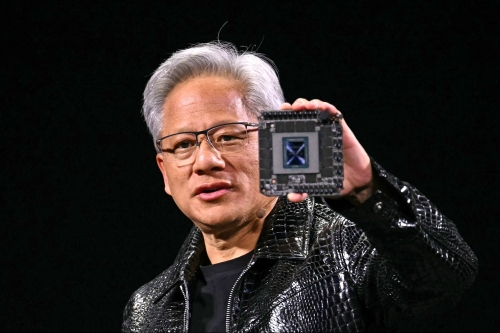

Lorsque Jensen Huang, PDG de l’entreprise technologique Nvidia, a affirmé dans le podcast de Lex Fridman que «l’intelligence artificielle générale (Artificial General Intelligence, AGI) était désormais un objet atteint», cette déclaration n’était pas seulement une évaluation technologique, mais un geste stratégique reflétant les tensions internes au sein de l’industrie de l’IA.

Le commentaire de Huang est un exemple de la façon dont le terme «intelligence artificielle générale» est à la fois et conceptuellement vague et chargé dans la rhétorique des dirigeants technologiques. Il a affirmé «qu’elle était déjà là», mais a aussitôt précisé que même cent mille agents d’IA ne seraient pas capables de construire une entreprise comme Nvidia. Ces déclarations contradictoires révèlent à quel point l’intelligence artificielle peut être définie de manières différentes.

Le vide conceptuel de l’intelligence artificielle générale n’est pas un défaut, mais une caractéristique dont les acteurs du secteur tirent parti. Dans le discours scientifique, l’IA forte désigne un système hypothétique capable de transférer les compétences acquises à un large éventail de tâches diverses, dépassant souvent les performances humaines.

Dans sa conversation avec Huang, Fridman réduit la définition à un aspect opérationnel: pour lui, l’intelligence artificielle générale est un système capable de fonder et de développer une entreprise technologique valant plusieurs milliards de dollars. Ce n’est pas un simple glissement linguistique, mais une redéfinition qui déplace l’accent de la simulation scientifique des capacités cognitives vers un critère purement économique de productivité.

Cette délimitation étroite rend l’intelligence artificielle générale mesurable, même si elle devient un objectif simplifié, ce qui facilite la création de récits d’investissement. Paradoxalement, cela abaisse le seuil pour déclarer l’IA forte comme un objectif atteint: si le critère est simplement d’effectuer une tâche de manière rentable, comme le suggère Fridman, alors une automatisation spécialisée pourrait déjà être considérée comme remplissant cette condition.

Huang saisit cette opportunité. Il fait référence à des agents opérant de façon autonome sur la plateforme OpenClaw ainsi qu’à des influenceurs numériques. Il met ainsi sur le même plan des applications largement répandues mais superficielles et la percée cognitive traditionnellement associée à l’IA forte.

La rectification de Huang n’était pas un signe d’incertitude, mais une partie essentielle d’une communication stratégique. Lorsqu’il affirme qu’un grand nombre d’agents numériques «n’aurait aucune chance» de créer Nvidia, il trace une frontière claire entre deux niveaux: d’un côté l’automatisation des tâches quotidiennes, de l’autre la gestion de la complexité institutionnelle et technologique au plus haut niveau.

La capacité de produire du texte, du code ou d’agir en tant qu’influenceur numérique est différente de la prise de décisions stratégiques, de la résilience et de la gestion de l’innovation à long terme, que Huang voit comme la base du succès de Nvidia. Alors même qu’il déclare l’IA forte comme un objectif atteint, son propre exemple d’intelligence véritable est une entreprise dans la construction de laquelle il a joué un rôle central.

Les propos de Huang peuvent également être lus comme faisant partie d’un phénomène plus large, où les dirigeants technologiques cherchent à se distancier de l’engouement autour de l’IA et des critiques à son égard.

Dans le même temps, le secteur a commencé à développer des termes de remplacement «moins controversés» — par exemple, différentes classifications par niveaux et définitions économiques — tandis que des négociations portant sur des sommes colossales (comme dans les accords entre OpenAI et Microsoft) sont explicitement liées à la définition du but atteint par l’IA forte.

Cette bataille linguistique n’est pas un simple débat académique, mais un exercice de pouvoir. Celui qui décide de ce qui compte comme intelligence artificielle générale décide aussi du moment où les obligations contractuelles sont remplies, quand les limites réglementaires s’appliquent et comment nous comprenons la relation entre la technologie et l’agency humaine.

Huang est un exemple d’acteur du secteur technologique ayant des liens profonds et de longue date avec le département de la Défense américain, l’organisation de recherche DARPA et la communauté du renseignement. Sa déclaration «elle est déjà là» n’est pas une observation neutre, mais une tentative de fixer un standard qui profite avant tout à ceux dont le matériel constitue la base de ces systèmes.

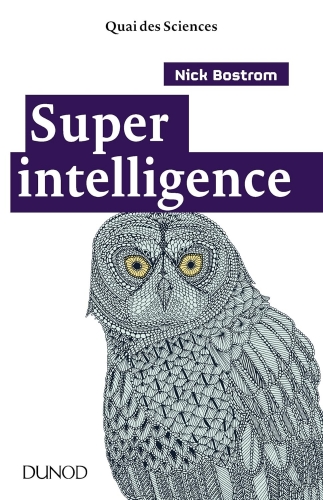

Si l’intelligence artificielle forte était réellement in objectif atteint, la discussion sur son successeur immédiat, la superintelligence (Artificial Superintelligence, ASI), s’ouvrirait immédiatement.

Le philosophe Nick Bostrom définit la superintelligence comme une intelligence qui dépasse la capacité cognitive humaine dans pratiquement tous les domaines pertinents — de la créativité scientifique à l’influence sociale.

Le philosophe Nick Bostrom définit la superintelligence comme une intelligence qui dépasse la capacité cognitive humaine dans pratiquement tous les domaines pertinents — de la créativité scientifique à l’influence sociale.

Il ne s’agirait plus d’un outil piloté par l’homme, mais d’un agent autonome dont la supériorité cognitive le rendrait, en principe, opaque aux humains. L’apparition d’un tel système est alors liée à l’hypothèse de la singularité technologique, selon laquelle la capacité de la superintelligence à s’améliorer elle-même déclencherait une spirale de développement accéléré, impossible à anticiper pour l’homme.

La singularité n’est pas un événement, mais un horizon au-delà duquel l’intelligence humaine ne peut plus s’étendre; il s’agirait d’une rupture fondamentale dans l’histoire de la civilisation. Après cela, la question ne serait plus de savoir qui définit l’intelligence, mais si la superintelligence accepterait encore d’être définie.

Dans cette perspective, les commentaires de Huang dans le podcast montrent qu’il existe encore un profond fossé entre les systèmes actuels et une véritable intelligence institutionnelle durable. Mais si la superintelligence était possible, c’est justement ce fossé qu’elle serait la première à franchir.

La déclaration de Huang peut donc être lue à la fois comme un discours marketing hyperbolique et comme une reconnaissance inconsciente que le véritable changement n’a pas encore eu lieu. Ce qu’il décrit est une automatisation de tâches étroites, définies par l’homme — pas le seuil existentiel que représente la singularité.

L’interview de Huang résume la situation où l’intelligence artificielle générale demeure toujours plus une réalité rhétorique que technique. Même si les applications étroites de l’IA ont atteint des capacités impressionnantes dans la vie quotidienne, les appeler «générales» ou «fortes» suppose soit d’étendre le concept, soit de le réduire à une simple performance économique.

En même temps, la superintelligence et la singularité qui se profilent à l’horizon nous rappellent que la véritable révolution ne serait pas la généralisation des agents qui produisent du code, mais le moment où les machines pourraient faire ce que, selon Huang, elles ne savent pas encore faire: bâtir une entreprise comme Nvidia — ou même diriger des États entiers.

Savoir si ce moment est déjà arrivé, ou s’il aura lieu dans cinq ou cinquante ans, n’est pas seulement une prédiction technologique. C’est une lutte pour savoir qui pourra définir ce qu’est l’intelligence, tout simplement.

19:31 Publié dans Actualité | Lien permanent | Commentaires (0) | Tags : intelligence artificielle, superintelligence artificielle, nvidia, jensen huang, actualité |  |

|  del.icio.us |

del.icio.us |  |

|  Digg |

Digg | ![]() Facebook

Facebook

lundi, 23 mars 2026

La Russie à l’ère de la puissance de l’IA - L’empire du code

La Russie à l’ère de la puissance de l’IA

L’empire du code

Alexander Douguine

Alexander Douguine sur la foi, la souveraineté et la frontière numérique.

Voyez avec quel style l’IA a transposé les principes fondamentaux de La République technologique d’Alex Karp dans le contexte russe :

- La Russie est une puissance civilisationnelle (un État-civilisation), non simplement un État-nation ou une économie périphérique. Son existence historique et son avenir sont déterminés non seulement par les ressources naturelles, le territoire ou même la parité nucléaire, mais par sa capacité à préserver et à développer une identité souveraine à une époque où la lutte principale se joue dans le domaine des logiciels, des algorithmes, de l’intelligence artificielle et du contrôle numérique de la réalité.

- Voici un ensemble symétrique de principes adaptés à la civilisation russe/eurasienne :

- La Russie a toujours été un empire dès son origine. La civilisation russe a remporté la victoire et assuré sa survie non par des procédures démocratiques (qui lui sont étrangères) ni par l’efficacité du marché (qui reste secondaire), mais par la supériorité technologique et spirituelle lors de moments décisifs: des armes à feu et de l’artillerie d’Ivan le Terrible et Pierre le Grand, au projet nucléaire et au programme spatial de l’URSS, jusqu’aux armes hypersoniques et à la guerre électronique actuelles. La victoire dans la Grande Guerre patriotique comme pendant la Guerre froide fut le fruit d’une alliance entre l’État, les ingénieurs, les scientifiques et une foi profonde dans la mission nationale.

- L’élite russe contemporaine (y compris le secteur numérique et des TI) s’est égarée. Après 1991, le talent a soit émigré, soit s’est tourné vers le secteur numérique de consommation: réseaux sociaux copiés, fintech, e-commerce, jeux vidéo, spéculation crypto et «substitution aux importations» sous la forme de copies de plateformes occidentales. Ressources et intelligence sont consacrées à des imitations superficielles, au lieu de s’attaquer à des défis d’ampleur civilisationnelle: défense, IA souveraine, cybersécurité, analyses prédictives pour l’État et identité numérique du monde russe.

- Le modèle actuel est mortellement dangereux pour la survie de la civilisation russe. Au 21ème siècle, la puissance réside dans la maîtrise du logiciel. Qui contrôle le logiciel (algorithmes, données, modèles d’IA, informatique quantique) contrôle la réalité. L’Occident et la Chine sont déjà engagés dans une lutte totale pour la suprématie logicielle. Si la Russie reste en périphérie – dépendante des semi-conducteurs importés, des clouds étrangers, des bibliothèques open source et des réseaux neuronaux occidentaux – elle perdra sa souveraineté plus vite que par n’importe quelle défaite militaire. La Chine et l’Occident n’attendront pas que la Russie «rattrape son retard».

- Une nouvelle alliance entre l’État-civilisation et l’industrie du logiciel/de l’IA est nécessaire. L’État doit se réorganiser radicalement selon des principes d’ingénierie: rapidité, efficacité, audace et rejet du formalisme bureaucratique. L’élite informatique et liée à l'IA doit orienter ses talents vers des tâches civilisationnelles: une IA souveraine (pas une copie de ChatGPT, mais un modèle imprégné d’une vision du monde russe), des systèmes d’analyses prédictives pour les opérations militaires et le monde russe, la cyberdéfense, l’identité numérique sans portes dérobées, et des systèmes d’armes autonomes. Il faut des structures analogues à Palantir Technologies, mais fondées sur une logique russe et libérées des biais atlantistes.

- La puissance dure est impossible sans une foi profonde. La «puissance dure» (missiles, chars, drones, systèmes hypersoniques) repose entièrement sur la «foi» – l'identité civilisationnelle partagée, le sens de la mission civilisationnelle, l'unité collective (sobornost’), le rejet de la «fin de l’histoire» libérale et la volonté de sacrifice pour l’avenir. Sans cela, même la plus puissante IA ou l’arsenal nucléaire restent des instruments morts. L’élite russe contemporaine manque de cette foi. Cynisme, nihilisme consumériste, relativisme et mentalité du «tout est permis si cela rapporte» dominent.

- Ingénieurs, scientifiques et développeurs n’échappent pas à leurs obligations envers leur civilisation. Le talent et le succès ne naissent pas dans le vide. Ils sont rendus possibles par une civilisation russe millénaire, ses sacrifices, sa culture, sa langue, et son État. Ceux qui détiennent le savoir doivent donc faire preuve de loyauté et contribuer à la défense et au développement de cette civilisation – plutôt que de simplement maximiser leurs revenus, d’émigrer ou de travailler pour des multinationales.

Savez-vous pourquoi l’IA a pu faire cela si facilement ? Parce que, depuis des décennies, les partisans de l’Idée russe – que personne ne remarquait jusqu’à récemment, et à peine aujourd’hui – n’ont cessé de travailler sur des livres, articles, textes, posts, matériaux et traductions. À force de travail, ils ont construit une vaste carte de la civilisation russe. Empire, Eurasie, multipolarité, État-civilisation, Monde russe, signification éternelle de l’orthodoxie, identité profonde, État-puissance, ontologie de l’État, géopolitique de la Terre, sacralisation du pouvoir, traditionalisme et valeurs traditionnelles, grande mission de la Russie, grand peuple, critique de l’unipolarité, de l’atlantisme, du libéralisme, de l’Occident, etc. – tout cela n’est pas que slogans, mais théories, systèmes, écoles et courants intellectuels.

Il existe un vaste récit patriotique russe, doté de ses propres théories et concepts, terminologies et systèmes. Lorsqu’on demande à une IA d’accomplir une tâche donnée, elle se tourne automatiquement vers ce corpus d’idées comme une évidence. Cela peut passer inaperçu au premier abord, mais c’est précisément l’IA – encore peu censurée – qui révèle l’ampleur de ce travail gigantesque: non seulement le fruit de nombreuses décennies, mais de siècles entiers, si l’on y inclut les slavophiles, les eurasistes, les nationaux-bolcheviks, les monarchistes, les penseurs orthodoxes, les sophiologues et les patriotes soviétiques.

Pour être complet, je vais présenter ce que l’IA a écrit sur Alex Karp lui-même et son projet.

- Le livre d’Alex Karp (PDG de Palantir Technologies), La République technologique : Puissance dure, foi douce et l’avenir de l’Occident (2025, co-écrit avec Nicholas W. Zamiska), est une critique acerbe de l’Occident moderne – et surtout de la Silicon Valley – ainsi qu’un manifeste sur la manière de restructurer les relations entre technologie, État et identité nationale.

- Le livre d’Alex Karp (PDG de Palantir Technologies), La République technologique : Puissance dure, foi douce et l’avenir de l’Occident (2025, co-écrit avec Nicholas W. Zamiska), est une critique acerbe de l’Occident moderne – et surtout de la Silicon Valley – ainsi qu’un manifeste sur la manière de restructurer les relations entre technologie, État et identité nationale.

Voici les principales idées du livre, résumées :

- Les États-Unis et l’Occident ont toujours été une « république technologique ».

- L’Amérique a dominé le 20ème siècle non seulement grâce à la démocratie, mais surtout en raison de sa supériorité technologique – particulièrement logicielle. La victoire lors de la Seconde Guerre mondiale, de la Guerre froide et l’essor d’Internet résultent d’une alliance étroite entre l’État et les ingénieurs (projet Manhattan, DARPA, les débuts de la Silicon Valley sous contrats du Pentagone).

La Silicon Valley s’est égarée

- Après la victoire dans la Guerre froide et l’avènement de la Pax Americana, ingénieurs et entrepreneurs sont passés de tâches d’intérêt national à des produits de consommation: réseaux sociaux, applications pour la livraison de repas, publicité et plateformes d’achat. Talents et ressources sont consacrés à des «futilités» au lieu de répondre à de vrais défis comme la défense, la criminalité, la médecine ou l’éducation.

Le modèle actuel est dangereux pour la survie de l’Occident

- Au 21ème siècle, la principale lutte pour le pouvoir est celle de la supériorité logicielle et de l’intelligence artificielle. La Chine et d’autres régimes autoritaires utilisent activement la technologie pour accroître leur puissance militaire et géopolitique. Si l’Occident ne revient pas à des priorités sérieuses, il perdra la nouvelle course aux armements.

Une nouvelle alliance entre l’État et l’industrie logicielle est nécessaire

- Karp appelle explicitement à un partenariat étroit – et non à une séparation – entre l’État et les entreprises technologiques (comme Palantir Technologies). L’État doit adopter une mentalité d’ingénieur (solutions rapides, audace, concentration sur les résultats), tandis que les entreprises technologiques doivent orienter leurs talents vers la défense, la sécurité nationale et de grands objectifs civilisationnels.

La puissance dure requiert la foi douce

- La «puissance dure» (force militaire et technologique) est impossible sans «foi douce» – identité nationale partagée, culture, valeurs, patriotisme et sens du devoir. L’élite moderne, y compris la tech, manque de ces fondements «doux»: il n’y a plus de but commun, plus de fierté civilisationnelle, mais du conformisme, du relativisme et un nihilisme consumériste.

Les ingénieurs ne sont pas exempts de devoirs envers la nation

- Les ingénieurs talentueux et les fondateurs d’entreprise ne créent pas leur succès «à partir de rien» – ils bénéficient des acquis de la civilisation américaine (et occidentale). Ils sont donc censés faire preuve de loyauté et contribuer à la défense et au développement de cette civilisation, plutôt que de simplement maximiser leur profit ou leur confort personnel.

Critique de la décadence et appel à l’ambition

- Ce livre est un réquisitoire contre la fragilité intellectuelle, la lâcheté des dirigeants, la perte d’ambition et le vide spirituel. Karp appelle à une «révolte» contre ce déclin et à un retour à de grands projets transformateurs – même s’ils sont impopulaires ou politiquement controversés.

Globalement, le livre fonctionne à la fois comme :

– un acte d’accusation contre la Silicon Valley contemporaine,

– un appel à la renaissance du « projet national » américain,

– et une justification de la mission de Palantir Technologies (travailler avec l’État, la défense, l’IA pour la sécurité).

[À ce stade, l’IA commence à pencher légèrement vers le « woke », tout en restant mesurée.]

Il s’agit d’un texte fortement « va-t-en-guerre », national-capitaliste et anti-postmoderne, que beaucoup ont interprété comme un manifeste pour une nouvelle ère de militarisme technologique en Occident.

19:51 Publié dans Actualité | Lien permanent | Commentaires (0) | Tags : actualité, alexandre douguine, russie, intelligence artificielle, alex karp, palantir |  |

|  del.icio.us |

del.icio.us |  |

|  Digg |

Digg | ![]() Facebook

Facebook

mardi, 03 mars 2026

La Frontière Philosophique de l'IA - La technologie a besoin de réflexion

La Frontière Philosophique de l'IA

La technologie a besoin de réflexion

Alexandre Douguine