Les violences gratuites, ces agressions physiques sans raison apparente qui peuvent aller jusqu’au meurtre, se multiplient de façon dramatique. Au lendemain du massacre particulièrement insoutenable d’une jeune femme, Axelle Dorier, percutée par un conducteur qui l’a traînée sur huit-cents mètres dans une rue de Lyon avant de prendre la fuite, nous avons souhaité recueillir l’avis du Dr. Maurice Berger dont le dernier ouvrage « Sur la violence gratuite en France: adolescents hyper-violents, témoignages et analyse » donne les principales clefs pour appréhender ce phénomène tant au niveaux des causes que des solutions.

Les violences gratuites ne sont ni une surprise, ni une fatalité. Pour les comprendre, et les analyser, il faut aller au contact des auteurs. En remontant le fil leur histoire, de leur éducation on finit par observer plus que des récurrences, plutôt de véritables modèles qui constituent la matrice de cette violence particulière à plusieurs titres, dont notamment la surreprésentation des auteurs d’origine maghrébine.

B-Mag: Quel est votre regard sur le drame de cette jeune femme percutée volontairement par un conducteur qui l’a ensuite traînée dans une rue de Lyon?

Dr. Maurice Berger :

Même si cela ne représente qu’une partie des problèmes de sécurité, la proportion de délinquants d’origine immigrée est effectivement importante, et cela mérite qu’on y réfléchisse. Je précise d’emblée que je travaille dans un Centre éducatif renforcé dépendant du Ministère de la Justice, et dont l’équipe est à 80 % originaire du Maghreb. Ceci montre que de nombreuses personnes appartenant à cette culture ont un fonctionnement compatible avec le respect des règles légales de la société. Dit autrement, on nait d’abord dans une famille qui transmet-ou non- des valeurs éducatives avant de naître dans un « quartier ».

A propos de la mort d’Axelle Dorier, la justice précisera les circonstances exactes de cet événement dramatique. Concernant l’auteur, je propose une hypothèse qui ne sera probablement pas explorée lors du procès. Le conducteur d’origine maghrébine est confronté à une jeune femme, d’origine européenne de surcroît, qui se met en travers de la route pour le faire s’arrêter, c’est-à-dire se soumettre. Dans la culture maghrébine, comme l’indique la sociologue Nassima Driss, l’espace est genré, l’espace public est masculin alors que la place de la femme se situe au sein du foyer. Il y a là une différence anthropologique de représentation de l’espace. Pour cette jeune femme, on doit agir en être responsable et donc discuter. Pour l’auteur, cela a peut-être été impensable car c’est l’homme qui commande.

Par ailleurs, j’entends l’indignation liée aux agressions mortelles récentes mais ces faits ne m’étonnent pas car nous vivons depuis des dizaines d’années dans un triple déni de la violence.

Un déni sociologique, celui qui a forgé le concept de « sentiment d’insécurité » alors qu’il y a une insécurité réelle, avec une violence gratuite toutes les 44 secondes en France en 2018.

Un déni médiatique, que je combats depuis 1992 lorsque j’ai décrit pour la première fois cette violence dont je commençais à voir l’augmentation dans ma pratique médicale, et où j’indiquais que nous allions avoir des milliers d’adultes violents dans vingt années à venir. En 2008, dans mon livre « Voulons-nous des enfants barbares ? Prévenir et traiter la violence extrême“, j’ai consacré un chapitre à la nécessité de comprendre les processus menant à la violence chez les adolescents maghrébins. Aucun des nombreux journalistes qui m’ont interviewé à propos de cet ouvrage n’a voulu évoquer ce chapitre, en m’expliquant que ce n’était pas politiquement correct.

Un déni politique aussi, le mot d’ordre étant « après moi, le déluge ».

On constate dans l’actualité quotidienne le résultat logique de ce triple aveuglement.

Je renvoie aussi à la récente étude d’Alain Bauer et Christophe Soullez, « Le grand retour de l’homicide? » (2020) qui montre une augmentation du nombre des homicides en France après une baisse de 60 % entre les années 1994 et 2014. Les chiffres de 2018 sont de 845. Ceux de 2019, autour de 950, donc une augmentation de 8,5 % en un an. Ce chiffre de 2019 est supérieur à celui de 2015 (872, incluant les attentats terroristes du Bataclan) et à celui de 2016 (892, incluant l’attentat de Nice). Les auteurs concluent : « En tout état de cause, un profond mouvement de retour à la violence physique semble se produire en Occident, ignoré, volontairement ou involontairement, ou sous-estimé (…), ce qui remet en cause un acquis fondateur : le droit de vivre ». Le crime est donc devenu un mode de traitement des litiges.

B-MAG: Quelle est la part de la maltraitance dans l’historique des sujets violents?

95% des sujets violents proviennent de familles maltraitantes au sens large qui englobe les négligences, avec souvent un trouble psychiatrique chez l’un des parents. 5% sont issus de familles sans problème éducatif majeur.

Mais parmi les éléments qui favorisent l’apparition d’un comportement violent, deux autres facteurs sont particulièrement fréquents. Tout d’abord, l’exposition à des violences conjugales avant l’âge de deux ans. Là où je travaille, ceci concerne 80 % des mineurs violents, lesquels ont intériorisé précocement ces scènes. Or ces violences conjugales sont plus fréquentes dans les cultures où il y a une inégalité homme-femme.

Un autre élément est un fonctionnement familial clanique, très répandu chez les gens du voyage, les familles kosovares et maghrébines. Un clan est comme un corps dont chaque individu est un membre. Alors que le but d’une famille devrait être que les parents cherchent à ce que leur enfant se construise une pensée personnelle et puisse s’éloigner d’eux pour se construire un projet personnel, dans une famille clanique le mode de pensée est indifférencié, le but n’est pas qu’un sujet pense par lui-même, son identité est d’abord d’appartenir au groupe. Le terme de ghettoïsation est donc inexact car on est enfermé dans un ghetto alors qu’ici au contraire, la contrainte est intérieure, autosécrétée, car c’est l’éloignement du groupe qui est angoissant, en pensée, ou physiquement hors du territoire. Les populations concernées n’ont pas été contraintes de se regrouper, ce sont elles qui choisissent de se concentrer sur la base d’une identité groupale. Et la représentation que les membres d’un clan ont de la relation n’est pas de personne à personne mais de groupe à groupe. Si l’un d’eux est en difficulté dans une relation, il rameute son groupe : « mes frères vont venir te tuer ». Ce mode clanique est un obstacle à l’intégration des individus, les codes du groupe peuvent primer sur les règles de la République.

Un autre élément est un fonctionnement familial clanique, très répandu chez les gens du voyage, les familles kosovares et maghrébines. Un clan est comme un corps dont chaque individu est un membre. Alors que le but d’une famille devrait être que les parents cherchent à ce que leur enfant se construise une pensée personnelle et puisse s’éloigner d’eux pour se construire un projet personnel, dans une famille clanique le mode de pensée est indifférencié, le but n’est pas qu’un sujet pense par lui-même, son identité est d’abord d’appartenir au groupe. Le terme de ghettoïsation est donc inexact car on est enfermé dans un ghetto alors qu’ici au contraire, la contrainte est intérieure, autosécrétée, car c’est l’éloignement du groupe qui est angoissant, en pensée, ou physiquement hors du territoire. Les populations concernées n’ont pas été contraintes de se regrouper, ce sont elles qui choisissent de se concentrer sur la base d’une identité groupale. Et la représentation que les membres d’un clan ont de la relation n’est pas de personne à personne mais de groupe à groupe. Si l’un d’eux est en difficulté dans une relation, il rameute son groupe : « mes frères vont venir te tuer ». Ce mode clanique est un obstacle à l’intégration des individus, les codes du groupe peuvent primer sur les règles de la République.

Il faut ajouter actuellement que beaucoup de délinquants sont aussi d’origine sahélienne, leur organisation psychique peut être influencée par la dimension polygamique de leur famille qui s’accompagne de mariages forcés précoces.

B-MAG: Dans votre dernier ouvrage, « Sur la violence gratuite en France », un concept que vous évoquez à titre de solution pour enrayer cette spirale de la violence est la « contenance ». Pouvez-vous en esquisser les contours?

La contenance est vraiment un élément essentiel de cet ouvrage, mais difficile à comprendre quand on n’est pas sur le terrain. Elle consiste avant toute chose à empêcher de manière physique la survenue d’un acte violent et à écouter les pensées qui surgissent alors chez le sujet.

Même si ce propos peut paraître choquant, mon expérience auprès d’enfants et d’adolescents violents m’a montré que la violence se combat par la force et qu’il s’agit d’un passage presqu’obligé pour que la pensée advienne chez eux.

Lorsqu’un sujet violent éprouve une forte tension, dans l’incapacité où il est de la mentaliser, il va la décharger sur l’extérieur. Avec la contenance qui peut constituer en un enveloppement dans une couverture, une mise en pièce d’apaisement ou d’isolement, on va leur donner une sorte de prothèse d’enveloppe, de peau. Ce n’est qu’alors qu’ils peuvent commencer à penser, justement parce qu’on a empêché cette décharge sur autrui. Cela signifie non pas que le sujet est mis en exil, mais qu’un professionnel est présent pour écouter les sentiments et les pensées qui vont apparaître chez lui, souvent pour la première fois. En pratique, c’est très difficile à mettre en oeuvre car il faut construire une équipe qui soit d’accord sur ces principes et qui accepte d’être disponible au gré des crises. Pour certains mineurs, la prison peut constituer plus qu’une sanction, mais aussi cette expérience de contenance

En France, le concept de contenance est très peu compris car il est balayé par un débat idéologique sur l’opposition entre répressif et éducatif.

B-Mag : Le futur ?

Lutter contre la violence actuelle nécessite un ensemble de mesures pédagogiques, la mise en place de dispositifs législatifs et judiciaires, un véritable « plan violence » ayant une cohérence globale et qui nécessiterait plusieurs changements de paradigme. En particulier, il faut commencer par arrêter de laisser grossir la quantité de sujets problématiques, sinon les professionnels comme moi ont le sentiment de vider la mer avec une petite cuillère. Je ne vois pas comment éviter une remise en cause de la CEDH et de son dogme du regroupement familial qui est à l’origine de « l’importation » de fonctionnements claniques. Ou encore, tout ceci coûte très cher: 560 euros par jour pour un jeune pris en charge dans un CER et 690 euros par jour dans un CEF (NDLR: centre éducatif renforcé et centre éducatif fermé). II y a 58% de mineurs étrangers non accompagnés dans les établissements pénitentiaires pour mineurs de Marseille (540 euros par jour), 40% à la maison d’arrêt de Fleury-Mérogis. Ce n’est un secret pour personne qu’une grande partie de ces mineurs sont en fait des majeurs. Je pense que tout mineur non accompagné qui vient commettre des délits en France doit être expulsé afin que nous puissions consacrer nos moyens déjà très insuffisants à la prise en charge des mineurs violents nationaux.

Maurice Berger est pédopsychiatre, psychanalyste, ex-professeur associé de psychologie de l’enfant. Il travaille en Centre Educatif Renforcé et enseigne à l’Ecole Nationale de la Magistrature.

Propos recueillis par Tatiana Hachimi

del.icio.us

del.icio.us

Digg

Digg

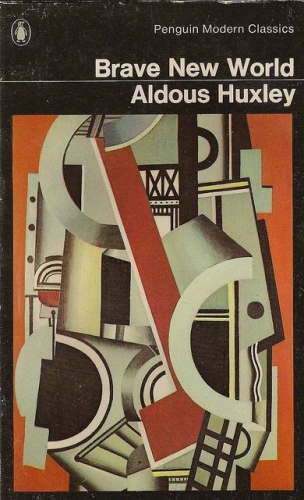

"Je crois que les oligarchies trouveront des moyens plus efficaces de gouverner et de satisfaire leur soif de pouvoir et seront semblables à celles décrites dans Brave New World (= Le meilleur des mondes)".

"Je crois que les oligarchies trouveront des moyens plus efficaces de gouverner et de satisfaire leur soif de pouvoir et seront semblables à celles décrites dans Brave New World (= Le meilleur des mondes)". Comme un monstre dans l'édition augmentée et mise à jour de mon livre intitulé Fake news (Arianna Editrice), les cas de censure, de boycott et d'attaques de plus en plus impitoyables contre l'information indépendante deviennent quotidiens.

Comme un monstre dans l'édition augmentée et mise à jour de mon livre intitulé Fake news (Arianna Editrice), les cas de censure, de boycott et d'attaques de plus en plus impitoyables contre l'information indépendante deviennent quotidiens.

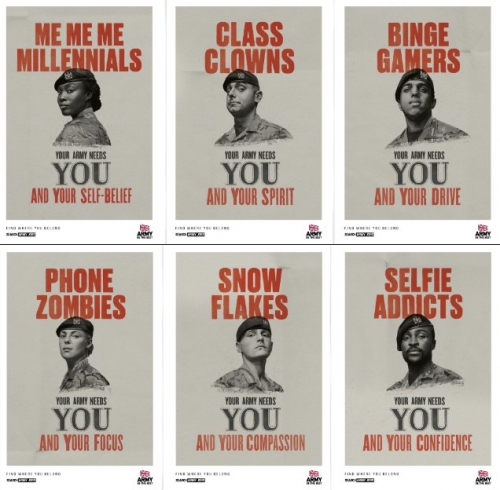

Tout est fait pour le divertissement immédiat : amusement constant, pornographie, drogues. La culture de la consommation nous focalise sur l'avoir au lieu de l'être, sur la possession au lieu des relations, sur les apparences au lieu du bien-être. Cela pousse à l'égoïsme, à l'égocentrisme, à la concurrence constante. Dans tous les domaines, on se compare toujours au niveau le plus haut, idéalisé, impossible à atteindre. La confusion et la frustration engendrées sont considérables. Résultat : des problèmes comme les maladies mentales, le taux de divorce, l'addiction aux drogues et à d'autres substances, et même les taux de criminalité n'ont fait qu'augmenter partout en Occident depuis les années 1950.

Tout est fait pour le divertissement immédiat : amusement constant, pornographie, drogues. La culture de la consommation nous focalise sur l'avoir au lieu de l'être, sur la possession au lieu des relations, sur les apparences au lieu du bien-être. Cela pousse à l'égoïsme, à l'égocentrisme, à la concurrence constante. Dans tous les domaines, on se compare toujours au niveau le plus haut, idéalisé, impossible à atteindre. La confusion et la frustration engendrées sont considérables. Résultat : des problèmes comme les maladies mentales, le taux de divorce, l'addiction aux drogues et à d'autres substances, et même les taux de criminalité n'ont fait qu'augmenter partout en Occident depuis les années 1950.

Das ist schon was: Mit Manfred Spitzers Warnung vor der »digitalen Demenz« hat ein Buch die obersten Ränge der Verkaufslisten gestürmt, das keinesfalls einen moderaten Ton anstimmt. Der bedeutende Hirnforscher lädt nicht zur Mäßigung vor der Glotze und an den Schaltknöpfchen der Spielautomaten ein. Er nennt keine empfehlenswerten Computerspiele, er beziffert keine Zeitzonen, innerhalb derer die Beschäftigung mit der virtuellen Welt tolerabel (oder gar günstig) wäre.

Das ist schon was: Mit Manfred Spitzers Warnung vor der »digitalen Demenz« hat ein Buch die obersten Ränge der Verkaufslisten gestürmt, das keinesfalls einen moderaten Ton anstimmt. Der bedeutende Hirnforscher lädt nicht zur Mäßigung vor der Glotze und an den Schaltknöpfchen der Spielautomaten ein. Er nennt keine empfehlenswerten Computerspiele, er beziffert keine Zeitzonen, innerhalb derer die Beschäftigung mit der virtuellen Welt tolerabel (oder gar günstig) wäre.

Ex:

Ex:

Es ist Elisabeth Badinter, seit Jahrzehnten Frankreichs (liberale!) Vorzeigefeministin, die ihr Land derzeit von einem massiven roll back in punkto Emanzipation bedroht sieht. Ihr Buch Le conflit. La femme et la mère, das in Frankreich gleich nach Erscheinen auf Platz 1 der Verkaufslisten schnellte und heiß diskutiert wurde, ist ein Plädoyer für die Abtrennung der mütterlichen Sphäre von der weiblichen Identität.

Es ist Elisabeth Badinter, seit Jahrzehnten Frankreichs (liberale!) Vorzeigefeministin, die ihr Land derzeit von einem massiven roll back in punkto Emanzipation bedroht sieht. Ihr Buch Le conflit. La femme et la mère, das in Frankreich gleich nach Erscheinen auf Platz 1 der Verkaufslisten schnellte und heiß diskutiert wurde, ist ein Plädoyer für die Abtrennung der mütterlichen Sphäre von der weiblichen Identität. Le Magazine littéraire consacrait jadis un dossier à l’ennui (n° 400, juillet – août 2001) sous le titre : « Éloge de l’ennui. Un mal nécessaire ». En d’autres termes, il s’agissait d’une interrogation sur la positivité de l’ennui au travers une enquête sur l’ennui au travers le travail de divers écrivains, notamment Flaubert, Proust, Pascal, Beckett, Moravia, Cioran.

Le Magazine littéraire consacrait jadis un dossier à l’ennui (n° 400, juillet – août 2001) sous le titre : « Éloge de l’ennui. Un mal nécessaire ». En d’autres termes, il s’agissait d’une interrogation sur la positivité de l’ennui au travers une enquête sur l’ennui au travers le travail de divers écrivains, notamment Flaubert, Proust, Pascal, Beckett, Moravia, Cioran.